Letztes Quartal benötigte unser Marketingteam Produktpreisdaten von sechs E-Commerce-Plattformen aus drei Ländern. Wir versuchten, einen eigenen Python-Scraper zu bauen, der jedoch nach einer Woche ausfiel, als zwei der Websites ihr Layout aktualisierten. Diese Erfahrung brachte uns auf die Suche nach einem zuverlässigen Web Scraping Anbieter, und die Suche war nicht so einfach, wie wir erwartet hatten.

Der Markt für Web Scraping Anbieter ist dramatisch gewachsen. Es gibt mittlerweile Dutzende von Optionen, die von visuellen No-Code-Scrapern über vollständige API-basierte Lösungen bis hin zu komplett verwalteten Managed Services (White-Glove) reichen. Preismodelle unterscheiden sich stark – einige berechnen pro API-Credit, andere pro Aufgabe oder pro GB Bandbreite. Und welche Funktionen am wichtigsten sind, hängt ganz vom technischen Know-how, den Skalierungsanforderungen und dem Budget Ihres Teams ab.

Wir haben Wochen damit verbracht, die beliebtesten Optionen zu testen und zu vergleichen. Dieser Leitfaden behandelt unsere Ergebnisse: Die 10 besten Web Scraping Dienste im Jahr 2026, aufgeschlüsselt nach Typ, mit ehrlichen Vor- und Nachteilen sowie Preisen, damit Sie das Tool auswählen können, das wirklich zu Ihrem Unternehmen passt.

TL;DR: Die Top 10 Web Scraping Anbieter im Vergleich

| Anbieter | Am besten für | Typ | Startpreis |

| Octoparse | Nicht-Programmierer & Teams, die visuelles Scraping in großem Maßstab benötigen | No-Code / Self-Service | Kostenlos; ab $119/Monat |

| ScraperAPI | Entwickler, die eine einfache Proxy- + Scraping-API wollen | API / Self-Service | $49/Monat |

| Bright Data | Proxy-Infrastruktur auf Enterprise-Ebene | API + Proxy / Self-Service | ~$500/Monat Minimum |

| Apify | Entwickler, die vorgefertigte Scraping-Actors wünschen | Cloud-Plattform / Self-Service | $49/Monat |

| ParseHub | Einfache visuelle Scraping-Projekte | No-Code / Self-Service | $189/Monat |

| Diffbot | KI-gestützte Extraktion strukturierter Daten | API / Self-Service | $299/Monat |

| WebScraper | Leichtgewichtiges browserbasiertes Scraping | Erweiterung / Self-Service | $50/Monat |

| Zyte | Teams, die bereits das Scrapy-Framework nutzen | Cloud-Plattform / Self-Service | $9/Einheit/Monat |

| PromptCloud | Unternehmen, die eine vollautomatische Datenlieferung ohne eigenen Aufwand wünschen | Managed / White-Glove | Auf Anfrage |

| Datahut | Kleine bis mittlere Projekte, die verwaltete Extraktion benötigen | Managed / White-Glove | Ab $40/Seite |

Was sind Web Scraping Anbieter?

Ein Web Scraping Anbieter ist eine Plattform, ein Tool oder ein Drittanbieter, der die Datenextraktion von Websites automatisiert und in strukturierten Formaten wie CSV, JSON oder Excel liefert. Anstatt benutzerdefinierte Scraper von Grund auf neu zu schreiben und zu warten, nutzen Unternehmen diese Dienste, um Webdaten in großem Maßstab zu sammeln – wobei die komplizierten Teile wie Proxy-Rotation, CAPTCHA-Lösung und JavaScript-Rendering im Hintergrund erledigt werden.

Zu den häufigsten Anwendungsfällen gehören die Preisüberwachung bei E-Commerce-Wettbewerbern (z. B. wenn Sie Shopify Produktdaten klonen möchten), Lead-Generierung aus Branchenbüchern, Marktforschung auf Bewertungsportalen, akademische Datenerfassung und die Einspeisung von Trainingsdaten in KI/ML-Pipelines.

Arten von Web Scraping Diensten

Bevor wir uns mit den einzelnen Tools befassen, ist es hilfreich, die drei großen Kategorien zu verstehen.

- Self-Service (No-Code) Dienste wie Octoparse und ParseHub bieten Ihnen eine visuelle Benutzeroberfläche zum Klicken und Konfigurieren von Scraping-Workflows, ohne Code schreiben zu müssen. Sie sind für Marketer, Analysten und Forscher ohne technische Unterstützung zugänglich. Der Kompromiss besteht darin, dass sehr komplexe Extraktionslogiken manchmal schwerer visuell darzustellen sind als in Code.

- Self-Service (API / für Entwickler) Dienste wie ScraperAPI, Bright Data und Apify bieten APIs und Programmier-Frameworks. Sie schreiben Skripte in Python, JavaScript oder anderen Sprachen, und der Dienst kümmert sich um Proxys, Browser-Rendering und die Umgehung von Bot-Schutzmaßnahmen. Diese bieten mehr Flexibilität, erfordern jedoch Entwicklungsressourcen.

- White-Glove (Managed) Dienste wie PromptCloud und Datahut übernehmen alles. Sie beschreiben, welche Daten Sie benötigen, und deren Team erstellt, betreibt und wartet die Scraper für Sie. Sie erhalten saubere Daten nach einem festgelegten Zeitplan. Dies ist die bequemste Option, aber auch die teuerste, und Sie opfern die Kontrolle über die Extraktionslogik.

Wichtige Funktionen, die Sie bewerten sollten

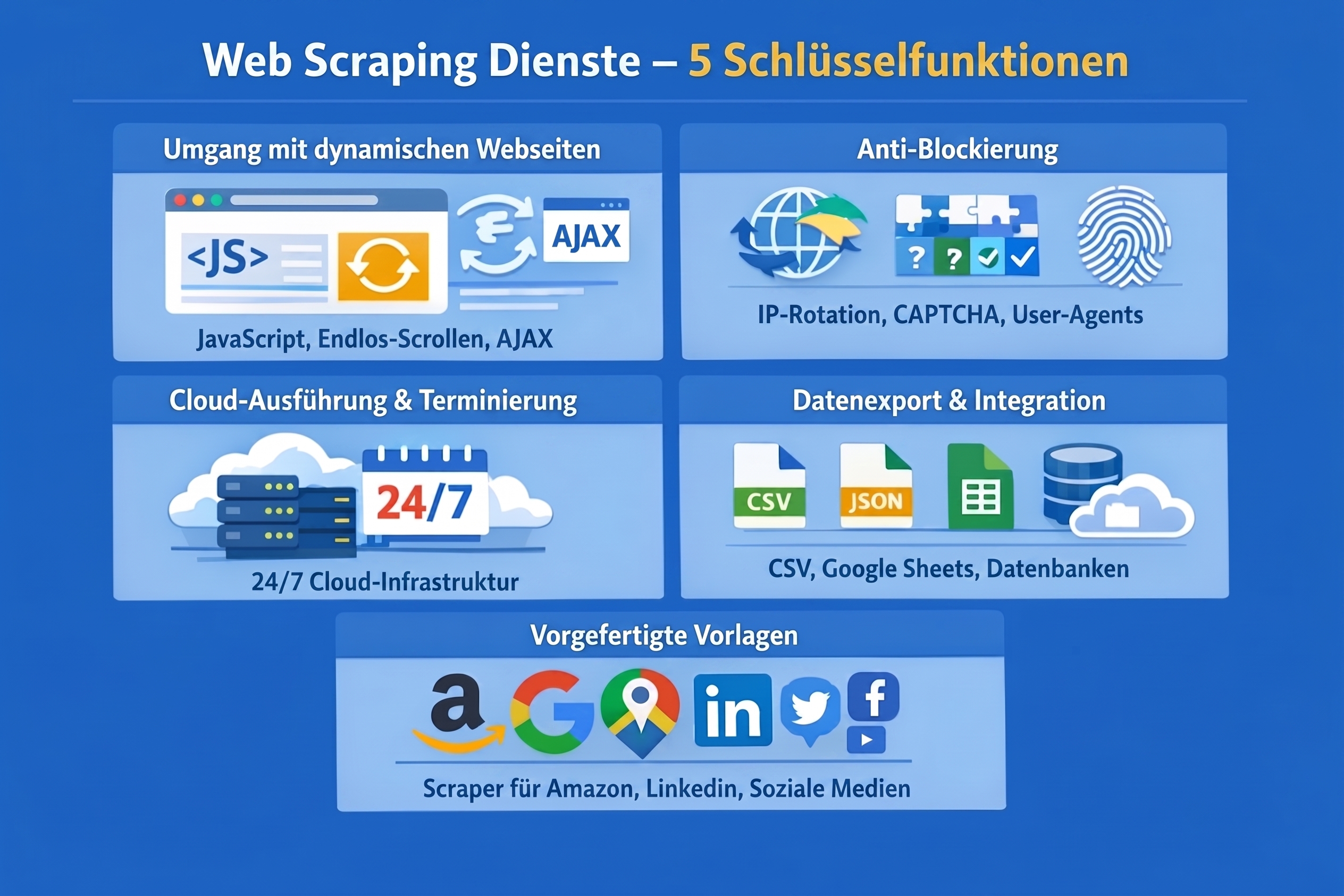

Beim Vergleich von Web Scraping Anbietern sind dies die Fähigkeiten, die zuverlässige Tools von solchen unterscheiden, die Sie schon im ersten Monat frustrieren werden:

- Umgang mit dynamischen Websites: Die meisten modernen Websites laden Inhalte mit JavaScript, Infinite Scrolling und AJAX-Anfragen. Jeder Dienst, der in Betracht gezogen wird, benötigt eine integrierte Browser-Engine, um diese Seiten zu rendern. Wenn er nur statisches HTML parsen kann, werden Sie auf den meisten kommerziellen Seiten Daten verpassen.

- Anti-Blocking-Funktionen: IP-Rotation, CAPTCHA-Lösung, User-Agent-Randomisierung und Browser-Fingerprinting sind für jedes ernsthafte Scraping-Projekt unerlässlich. Ohne diese werden Sie auf geschützten Seiten wie Amazon oder LinkedIn innerhalb von Stunden blockiert, insbesondere wenn Sie einen strengen Cloudflare Bot Schutz umgehen müssen.

- Cloud-Ausführung und Zeitplanung: Das Ausführen von Scrapern auf Ihrem lokalen Rechner ist für einen schnellen Test in Ordnung, aber Produktions-Workloads benötigen eine Cloud-Infrastruktur. Achten Sie auf eine 24/7-Cloud-Ausführung, flexible Zeitpläne (stündlich, täglich, wöchentlich) und gleichzeitige Verarbeitung, um große Aufgaben schneller zu bewältigen.

- Datenexport und Integration: Die Datenbereitstellung sollte einfach sein. Mindestens benötigen Sie CSV-, Excel- und JSON-Exporte. Bessere Dienste bieten eine direkte Integration mit Google Sheets, Datenbanken (MySQL, PostgreSQL), Cloud-Speicher (S3) und Automatisierungsplattformen wie Zapier.

- Vorgefertigte Vorlagen: Für beliebte Ziele wie Amazon, Google Maps, LinkedIn und Social-Media-Plattformen sparen vorgefertigte Vorlagen oder “Actors” Stunden an Konfigurationszeit. Die Breite und Qualität der Vorlagenbibliothek eines Dienstes sind starke Unterscheidungsmerkmale.

Die 10 besten Web Scraping Anbieter im Jahr 2026

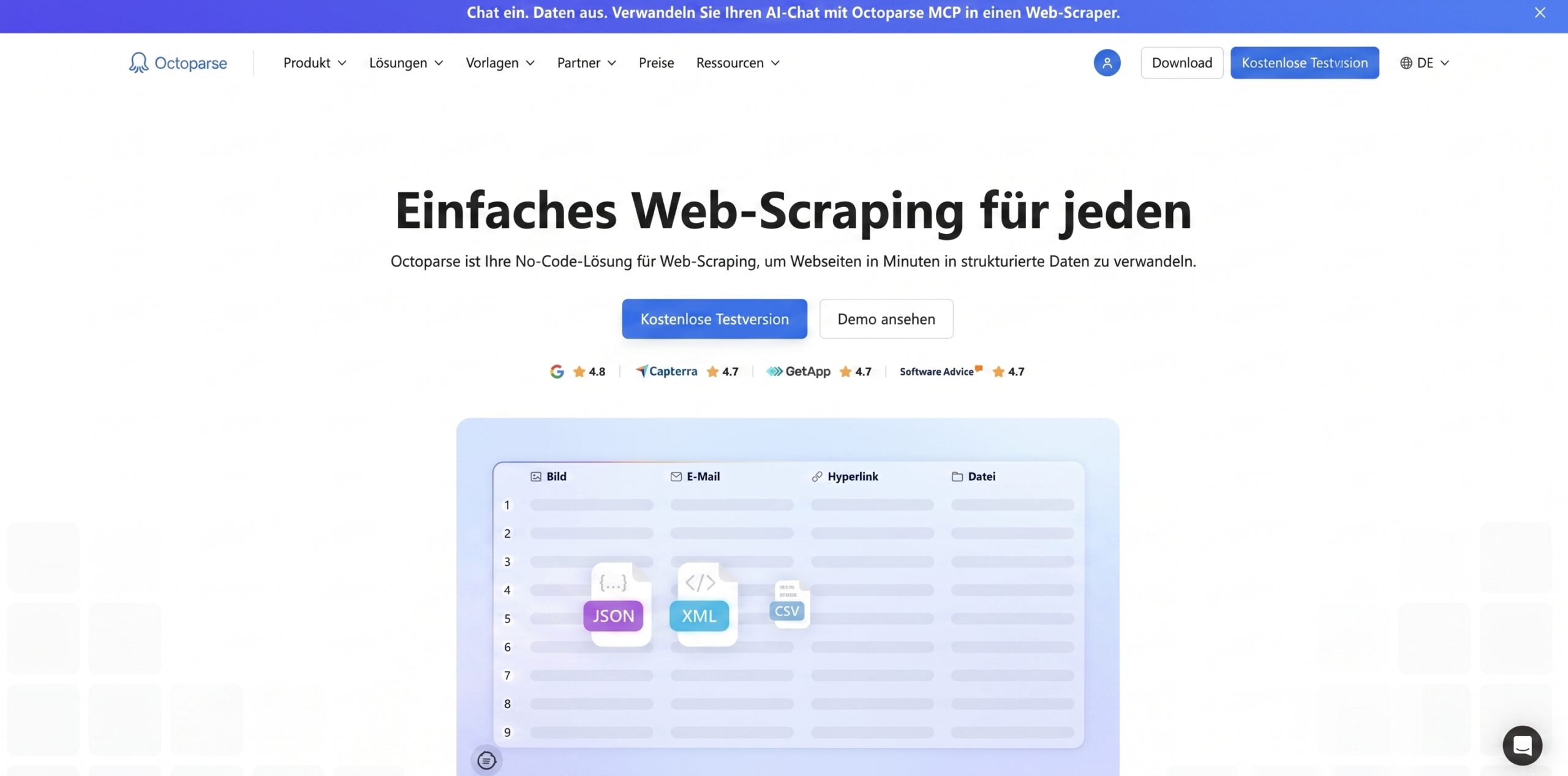

1. Octoparse: Der beste Allrounder für No-Code Web Scraping

Octoparse hat sich im Stillen zu einem der leistungsfähigsten No-Code Web Scraping Anbieter und Plattformen auf dem Markt entwickelt. Es kombiniert einen visuellen Point-and-Click-Workflow-Builder mit einer ernstzunehmenden Infrastruktur — Cloud-Ausführung, IP-Rotation, CAPTCHA-Lösung und über 469 vorgefertigte Scraping-Vorlagen — in einem Paket, das es nicht erfordert, eine einzige Zeile Code zu schreiben.

Was Octoparse von anderen No-Code-Scrapern abhebt, ist, wie weit Sie es ausreizen können, bevor Sie an eine Grenze stoßen. Der visuelle Workflow-Designer bewältigt Paginierung, Infinite Scrolling, Dropdown-Menüs, AJAX-geladene Inhalte und sogar passwortgeschützte Seiten. Als wir es auf einer stark JavaScript-basierten E-Commerce-Seite getestet haben, erfasste es jedes dynamisch geladene Produkt ohne jegliche manuelle Konfiguration, außer dem Anklicken der gewünschten Elemente.

Die größten Stärken:

- 665+ vorgefertigte Vorlagen für beliebte Websites, einschließlich Amazon, Google Maps, TikTok, LinkedIn und Dutzende mehr. Geben Sie ein paar Parameter ein und beginnen Sie sofort mit der Extraktion – keine Workflow-Einrichtung erforderlich.

- Vollständige Anti-Blocking-Suite: Integrierte Residential-Proxys, automatische IP-Rotation, CAPTCHA-Lösung und Browser-Fingerprint-Randomisierung. Sie müssen keine externen Proxy-Pools beschaffen oder verwalten.

- 24/7 Cloud-Extraktion mit Aufgabenplanung in minütlichen, stündlichen, täglichen oder wöchentlichen Intervallen. Ihre Scraper laufen auf den Servern von Octoparse, nicht auf Ihrem Rechner.

- Flexibler Datenexport: CSV, Excel, JSON, HTML, XML sowie direkte Exporte zu Google Sheets, MySQL, PostgreSQL und Amazon S3.

- API-Zugang zur Integration gescraapter Daten in Ihre eigenen Anwendungen und zur Automatisierung von Workflows.

- RPA (Robotic Process Automation) Funktionen für Aufgaben, die über reine Datenextraktion hinausgehen – Formulare ausfüllen, durch mehrstufige Prozesse klicken.

- Voice-of-Customer (VOC) Analyse: eine einzigartige Funktion, die Kundenbewertungsdaten für Stimmungsanalysen extrahiert und strukturiert.

Wo Octoparse wirklich glänzt, ist die Balance zwischen Benutzerfreundlichkeit und Leistung. Ein Marketing-Analyst ohne Programmiererfahrung kann mit dem visuellen Builder in unter 30 Minuten eine komplexe Scraping-Aufgabe einrichten. Gleichzeitig wird ein Datenteam, das Hunderte von geplanten Cloud-Aufgaben ausführt, der Plattform nicht entwachsen — der Professional-Plan unterstützt bis zu 20 gleichzeitige Cloud-Prozesse.

Ich war ehrlich gesagt von der Vorlagenbibliothek überrascht. Wir brauchten TikTok-Profildaten für ein Social-Media-Audit, und anstatt einen benutzerdefinierten Workflow zu erstellen, wählten wir eine vorgefertigte Vorlage, gaben die Profil-URLs ein und hatten in wenigen Minuten strukturierte Daten. Das ist eine echte Zeitersparnis für Teams, die mit mehreren Datenquellen jonglieren.

Detaillierte Preise und Pläne ansehen:

| Plan | Preis | Aufgaben | Cloud-Prozesse |

| Kostenlos | $0 | 10 | Nur lokal |

| Standard | $119/Monat | 100 | 3–6 |

| Professional | $299/Monat | 250 | Bis zu 20 |

| Enterprise | Auf Anfrage | 750+ | Benutzerdefiniert |

Add-ons wie Residential-Proxys ($3/GB) und CAPTCHA-Lösung ($1–$1,50 pro Tausend) sind verfügbar, falls Ihre Projekte stark geschützte Seiten betreffen.

Eine Sache, die Sie beachten sollten: Wenn Sie den visuellen Workflow-Builder zum ersten Mal öffnen, gibt es eine Lernkurve. Die Benutzeroberfläche ist mächtig, aber dicht. Ich empfehle, vor Ihrem ersten echten Projekt ein Tutorial-Video anzusehen—Octoparse hat eine solide Bibliothek an Anleitungen. Nach den ersten zwei oder drei Aufgaben hat man den Dreh raus.

Fazit: Wenn Ihr Team zuverlässiges, groß angelegtes Web Scraping ohne Code benötigt, ist Octoparse die stärkste Option im Jahr 2026. Die Kombination aus visuellem Workflow-Building, einer riesigen Vorlagenbibliothek, integriertem Anti-Blocking und Cloud-Infrastruktur zu einem wettbewerbsfähigen Preis ist schwer zu schlagen.

2. ScraperAPI: Am besten für Entwickler, die eine einfache API-Integration suchen

ScraperAPI ist ein entwicklerorientierter Scraping-Proxy, der IP-Rotation, Browser-Rendering und CAPTCHA-Lösung über einen einfachen API-Aufruf abwickelt. Sie senden eine URL; es gibt das HTML zurück. Die Einfachheit ist der Reiz—es gibt keinen visuellen Builder, keinen Workflow-Designer, nur eine saubere API, die Sie mit einer einzigen Codezeile in jedes Python-, JavaScript-, PHP- oder Ruby-Projekt integrieren können.

Die größten Stärken:

- Einfache API: ein Endpunkt, ein API-Schlüssel, fügen Sie die Ziel-URL als Parameter hinzu

- Automatische Proxy-Rotation mit Residential-, Datacenter- und mobilen Proxys

- JavaScript-Rendering für dynamische Seiten

- Strukturierte Daten-Endpunkte für beliebte Seiten (Amazon, Google usw.) geben vorgeparstes JSON zurück

- DataPipeline-Funktion zur Planung und Verwaltung von Scraping-Jobs ohne Code

Preise:

| Plan | Preis | API-Credits |

| Hobby | $49/Monat | 100.000 |

| Startup | $149/Monat | 1.000.000 |

| Business | $299/Monat | 3.000.000 |

Überlegungen: ScraperAPI ist eine hervorragende Proxy- und Rendering-Schicht, aber Sie müssen immer noch Ihre eigene Parsing-Logik schreiben, um bestimmte Datenfelder aus dem zurückgegebenen HTML zu extrahieren. Wenn Sie ein Entwickler sind, ist das in Ordnung. Wenn Sie ein nicht-technischer Benutzer sind, ist dies nicht die richtige Wahl — Sie wären mit dem visuellen Ansatz von Octoparse besser bedient, der sowohl das Abrufen als auch die Datenextraktion in einer Oberfläche vereint.

3. Bright Data: Am besten für Proxy-Infrastruktur auf Enterprise-Ebene

Bright Data ist der unangefochtene Marktführer in der Webdaten-Branche. Mit über 150 Millionen Residential-IPs, vorgefertigten Scraper-APIs für 120+ Domains, einem Scraping-Browser, der mit Puppeteer und Playwright kompatibel ist, und vorgefertigten Datensätzen ist es die umfassendste verfügbare Plattform. Es ist jedoch auch am komplexesten zu navigieren und am teuersten.

Die größten Stärken:

- Größtes Proxy-Netzwerk der Branche (150M+ Residential-, Mobile-, ISP-, Datacenter-IPs)

- Web Scraper API mit vorgefertigten Kollektoren für 120+ große Websites

- Scraping Browser integriert sich in Playwright und Puppeteer

- Vorgefertigte Datensätze für E-Commerce, Immobilien, Jobs und Social Media

- DSGVO- und CCPA-konform mit strengen KYC-Prozessen

Preise: Verbrauchsabhängig und variiert je nach Produkt. Proxy-Preise reichen von ~$3/GB (Datacenter) bis $15+/GB (Residential). Die Web Scraper API berechnet $1,50–$2,50 pro 1.000 Anfragen. Eine sinnvolle Nutzung beginnt bei etwa $500/Monat oder höher. Enterprise-Pläne erfordern die Kontaktaufnahme mit dem Vertrieb.

Überlegungen: Bright Data ist leistungsstark, aber für kleine Teams überwältigend. Das Preismodell ist komplex — Sie jonglieren mit Proxy-Kosten pro GB, API-Gebühren pro Anfrage und potenziellen Rechengebühren. Für Teams, die massive Skalierung benötigen und über Entwicklungsressourcen verfügen, ist es kaum zu schlagen. Für alle anderen sind die Lernkurve und die Kostenbarriere signifikant. Octoparse bietet einen viel zugänglicheren Einstieg mit vorhersehbaren monatlichen Preisen und ohne die Notwendigkeit, die Proxy-Infrastruktur separat zu verwalten.

4. Apify: Bester Marktplatz für vorgefertigte Scraper

Apify betreibt eine Cloud-Plattform mit einem Marktplatz für vorgefertigte Scraping-Skripte namens “Actors”. Es gibt Actors für das Scraping von Amazon, Instagram, Google Maps, LinkedIn und Hunderten anderen Seiten. Sie können auch benutzerdefinierte Actors in JavaScript oder Python erstellen.

Die größten Stärken:

- Großer Marktplatz mit Tausenden von Community-erstellten und offiziellen Scraping-Actors

- Entwicklung benutzerdefinierter Actors mit JavaScript/Node.js oder Python

- Cloud-Ausführung mit Unterstützung für Headless-Browser (Puppeteer, Playwright)

- API-Zugang für Workflow-Automatisierung

- Großzügiges kostenloses Kontingent zum Testen

Preise:

| Plan | Preis |

| Kostenlos | $0 (limitiert) |

| Starter | $49/Monat |

| Scale | $499/Monat |

| Business | $999/Monat |

Überlegungen: Der Actor-Marktplatz von Apify ist eine Stärke und eine Schwäche zugleich. Die Qualität variiert — einige Community-Actors gehen kaputt, wenn sich Zielseiten ändern, und die Wartung hängt vom ursprünglichen Autor ab. Die Plattform ist stärker auf Entwickler ausgerichtet als No-Code-Tools. Wenn Sie einen visuellen Workflow mit zuverlässigen, offiziell gepflegten Vorlagen bevorzugen, bieten die über 469 First-Party-Vorlagen von Octoparse eine konsistentere Erfahrung.

5. ParseHub: Am besten für einfache visuelle Scraping-Projekte

ParseHub bietet eine Point-and-Click-Scraping-Oberfläche, die JavaScript-gerenderte und dynamische Websites verarbeiten kann. Es ist im Konzept ähnlich wie Octoparse und wird oft als Octoparse Alternative betrachtet, hat aber einen engeren Funktionsumfang.

Die größten Stärken:

- Visuelle, codefreie (No-Code) Benutzeroberfläche

- Unterstützt JavaScript-Rendering und dynamische Inhalte

- Cloud-basierte Zeitplanung und Speicherung

- Exporte nach CSV, Excel, JSON

Preise:

| Plan | Preis | Seiten pro Lauf |

| Standard | $189/Monat | 10.000 |

| Professional | $599/Monat | 10.000+ |

| Enterprise | Auf Anfrage | Unbegrenzt |

Überlegungen: ParseHub ist unkompliziert, aber limitiert. Es fehlt eine integrierte CAPTCHA-Lösung und Geotargeting, was bedeutet, dass Sie auf stark geschützten Seiten an Grenzen stoßen. Der Preis ist hoch für das, was Sie bekommen—der Standard-Plan von Octoparse für $119/Monat beinhaltet mehr Aufgaben, Cloud-Ausführung, Anti-Blocking-Funktionen und eine viel größere Vorlagenbibliothek. ParseHub ist in Ordnung für leichtgewichtige Projekte, skaliert aber nicht so gut für Produktions-Workloads.

6. Diffbot: Am besten für KI-gestützte automatische Datenextraktion

Diffbot nutzt maschinelles Lernen, um strukturierte Daten aus Webseiten automatisch zu identifizieren und zu extrahieren. Richten Sie es auf eine Artikelseite, und es gibt Titel, Autor, Fließtext und Veröffentlichungsdatum als strukturiertes JSON zurück, ohne jegliche Konfiguration oder Regeleinrichtung.

Die größten Stärken:

- KI-gestützte Extraktion: keine manuellen Selektoren oder Workflow-Konfiguration erforderlich

- Hohe Genauigkeit für Artikel, Produkte, Diskussionsforen und Profilseiten

- Knowledge Graph API für den Datenabruf auf Entitätsebene

- Batch- und Echtzeit-API-Zugang

Preise:

| Plan | Preis | API-Credits |

| Startup | $299/Monat | 250.000 |

| Plus | $899/Monat | 1.000.000 |

| Enterprise | Auf Anfrage | Benutzerdefiniert |

Überlegungen: Der KI-Ansatz von Diffbot funktioniert gut für gängige Seitentypen (Produktseiten, Artikel), gibt Ihnen jedoch keine Kontrolle, wenn er Elemente falsch klassifiziert oder Daten übersieht. Für Projekte, bei denen Sie eine präzise, konfigurierbare Extraktion benötigen — bei der Sie genau wählen, welche Felder wie erfasst werden sollen — bietet Ihnen der visuelle Selektor von Octoparse diese Kontrolle, während er dennoch codefrei bleibt.

7. WebScraper: Beste leichtgewichtige Browser-Erweiterung

WebScraper.io ist eine Chrome-Erweiterung, mit der Sie Sitemaps erstellen können, um zu navigieren und Daten aus Websites zu extrahieren. Es ist für die lokale Nutzung kostenlos, mit kostenpflichtigen Cloud-Plänen für Zeitplanung und größere Aufgaben.

Die größten Stärken:

- Kostenlose Chrome-Erweiterung für grundlegendes Scraping

- Sitemap-basierte Datenextraktionslogik

- Cloud-Pläne für geplantes, automatisiertes Scraping

- Exporte nach CSV, Excel, JSON

Preise:

| Plan | Preis | Cloud-Credits (1 Credit = 1 Seite) |

| Project | $50/Monat | 5.000 |

| Professional | $100/Monat | 20.000 |

| Business | $200/Monat | 50.000 |

Überlegungen: WebScraper.io ist leichtgewichtig und erschwinglich für kleine Jobs, hat aber Probleme mit dynamischen Inhalten und JavaScript-lastigen Seiten. Es hat kein integriertes Anti-Blocking, keine CAPTCHA-Lösung und begrenzte Unterstützung für komplexe Seiteninteraktionen. Für alles, was über einfaches Scraping hinausgeht, bietet Octoparse weitaus mehr Funktionen zu einem vergleichbaren Preis — und die Cloud-First-Architektur ist zuverlässiger für den produktiven Einsatz.

8. Zyte: Am besten für Nutzer des Scrapy-Frameworks

Wenn Ihr Team bereits das Open-Source-Framework Scrapy verwendet, können Sie mit Scrapy Cloud (von Zyte) Ihre Spider in der Cloud bereitstellen, planen und überwachen. Es ist im Wesentlichen Cloud-Hosting für Scrapy-Projekte mit zusätzlichem Monitoring und Retry-Handling.

Die größten Stärken:

- Direkte Bereitstellung für Scrapy-Spider

- Cloud-basierte Zeitplanung, Protokollierung und Überwachung

- Datenspeicherung und Export (JSON, CSV, XML)

- Automatisches Retry- und Ban-Handling

Preise: Beginnt bei $9/Einheit/Monat (1 Einheit = 1 GB RAM + 1 gleichzeitiger Crawl). Eine Hochskalierung bedeutet das Hinzufügen von Einheiten, und die Kosten können bei großen Projekten unvorhersehbar werden.

Überlegungen: Dies ist nur relevant, wenn Ihr Team über Scrapy-Expertise verfügt. Es gibt keinen visuellen Builder, keine Vorlagen. Sie schreiben und pflegen Python-Spider. Für Teams ohne dedizierte Entwickler bietet Octoparse die gleiche Cloud-Ausführung und Zeitplanung mit einer visuellen Oberfläche, die keine Python-Kenntnisse erfordert.

9. PromptCloud: Bester Fully Managed Web Scraping Anbieter

PromptCloud ist ein White-Glove-Service: Sie teilen ihnen mit, welche Daten Sie benötigen, und ihr Team erstellt, betreibt und wartet die gesamte Scraping-Pipeline. Sie erhalten saubere, strukturierte Daten nach Zeitplan über API, S3 oder andere Bereitstellungsmethoden.

Die größten Stärken:

- Komplett verwaltet — keine technische Beteiligung Ihres Teams erforderlich

- Maßgeschneiderte Extraktions-Workflows nach Ihren Anforderungen

- Skalierbare Infrastruktur für hochvolumige, fortlaufende Datenerfassung

- Mehrere Datenbereitstellungsformate und -methoden

- Dedizierter Kundensupport

Preise: Nur auf Anfrage, basierend auf Projektumfang, Datenvolumen und Häufigkeit. Erwarten Sie deutlich höhere Kosten als bei Self-Service-Tools.

Überlegungen: PromptCloud akzeptiert keine einmaligen Scraping-Anfragen; sie konzentrieren sich auf fortlaufende Datenfeeds. Wenn Sie mehr Kontrolle über Ihre Extraktionslogik wünschen und sich nicht bei jeder Anpassung auf einen Drittanbieter verlassen möchten, gibt Ihnen ein Self-Service-Tool wie Octoparse diese Autonomie, während es für nicht-technische Benutzer weiterhin zugänglich bleibt.

10. Datahut: Bester Managed Service für kleinere Projekte

Datahut bietet verwaltetes Web Scraping mit einem zweistufigen Qualitätssicherungsprozess (Maschinen- + menschliche Prüfungen). Sie sind für kleinere oder einmalige Projekte zugänglicher als PromptCloud.

Die größten Stärken:

- Verwaltete Extraktion mit Genauigkeitsgarantie

- Flexible Bereitstellung über API, FTP, S3, Dropbox oder E-Mail

- Spezialisierte Lösungen für E-Commerce- und Immobiliendaten

- Beginnt bei $40/Seite für grundlegende Extraktionen

Preise: Nutzungsbasiert, ab $40 pro Website. Individuelle Preise für größere Projekte und Enterprise-Anforderungen.

Überlegungen: Gut für Teams, die wirklich keine Zeit in die Scraping-Einrichtung investieren können. Aber bei $40 pro Seite und individuellen Preisen, die schnell ansteigen, könnten Sie den Standard-Plan von Octoparse für $119/Monat nutzen und 100 verschiedene Seiten selbst scrapen — mit voller Kontrolle darüber, was Sie wann extrahieren.

Self-Service vs. Managed: Welchen Typ sollten Sie wählen?

- Wählen Sie Self-Service (No-Code), wenn Sie Teammitglieder haben, die 30 Minuten bis eine Stunde aufwenden können, um ein visuelles Scraping-Tool zu erlernen. Octoparse ist hier die stärkste Option — seine Vorlagenbibliothek bedeutet, dass viele Aufgaben fast keine Einrichtung erfordern, und der visuelle Builder erledigt den Rest.

- Wählen Sie Self-Service (API), wenn Ihr Team Entwickler hat, die lieber Code schreiben und eine granulare Kontrolle über die Anfragenbearbeitung wünschen. ScraperAPI und Apify sind solide Optionen, je nachdem, ob Sie rohe HTML-Rückgaben oder vorgefertigte Scraping-Skripte wünschen.

- Wählen Sie Managed/White-Glove, wenn Ihre Datenanforderungen hochspezialisiert sind, Ihr Volumen massiv ist und Sie keine technischen Ressourcen zuweisen können. PromptCloud und Datahut übernehmen alles, aber Sie zahlen einen Aufpreis für diesen Komfort.

Für die meisten Unternehmen trifft eine Self-Service-No-Code-Lösung wie Octoparse genau den Sweet Spot: leistungsstark genug für den produktiven Einsatz, zugänglich genug für Nicht-Entwickler und preislich so vorhersehbar, dass man gut budgetieren kann.

Checkliste für die endgültige Entscheidung

Bevor Sie sich für einen Web Scraping Anbieter entscheiden, testen Sie ihn anhand dieser Kriterien:

- Können Sie schnell loslegen? Nutzen Sie den kostenlosen Plan oder die Testversion. Wenn Sie eine grundlegende Scraping-Aufgabe nicht innerhalb einer Stunde abschließen können, ist das Tool zu komplex für Ihr Team.

- Kommt es mit Ihren Zielseiten zurecht? Testen Sie es an den tatsächlichen Websites, die Sie scrapen müssen, insbesondere an JavaScript-lastigen oder durch Anti-Bot-Maßnahmen geschützten Seiten.

- Sind Vorlagen für Ihre Ziele verfügbar? Vorgefertigte Vorlagen für Seiten wie Amazon, Google Maps oder LinkedIn können die Einrichtungszeit von Stunden auf Minuten reduzieren. Die Bibliothek von Octoparse mit 469+ Vorlagen ist die größte unter den No-Code-Tools.

- Ist Anti-Blocking integriert? Sie sollten Ihre eigenen Proxys nicht separat beschaffen und verwalten müssen. Integrierte IP-Rotation, CAPTCHA-Lösung und Fingerprint-Management sollten Grundvoraussetzung sein.

- Kann es mit Ihnen skalieren? Cloud-Ausführung, gleichzeitige Verarbeitung und Zeitplanung sind für Produktions-Workloads unerlässlich. Stellen Sie sicher, dass der Dienst nicht zum Flaschenhals wird, wenn Ihr Datenbedarf wächst.

- Ist die Preisgestaltung transparent? Wissen Sie genau, wofür Sie bezahlen — pro Aufgabe, pro Credit, pro GB. Vorhersehbare monatliche Preise (wie das Abonnementmodell von Octoparse) sind einfacher zu budgetieren als eine verbrauchsabhängige Abrechnung, die stark schwankt.

Der richtige Web Scraping Anbieter hängt von Ihrem Team, Ihrem technischen Komfortlevel und Ihren Datenzielen ab. Wenn wir jedoch einen Startpunkt für die meisten Unternehmen im Jahr 2026 empfehlen müssten, wäre es Octoparse. Melden Sie sich für den kostenlosen Plan an, testen Sie ein paar Vorlagen auf Ihren Zielseiten und führen Sie Ihr erstes Cloud-Scraping durch. Sie werden innerhalb einer Stunde wissen, ob es passt.

FAQs zu Web Scraping Anbietern

- Was ist der beste Web Scraping Anbieter für Anfänger?

Octoparse ist die erste Wahl für Anfänger. Seine visuelle Point-and-Click-Oberfläche erfordert keine Programmierung, und die Bibliothek mit 469+ vorgefertigten Vorlagen ermöglicht es Ihnen, Daten von beliebten Seiten zu extrahieren, indem Sie einfach eine URL und ein paar Parameter eingeben. Der kostenlose Plan gibt Ihnen 10 Aufgaben zum Testen vor einem Upgrade.

- Können Web Scraping Anbieter CAPTCHAs umgehen?

Ja — die meisten professionellen Dienste beinhalten eine CAPTCHA-Lösung. Octoparse, ScraperAPI und Bright Data verarbeiten CAPTCHAs automatisch. Grundlegende Tools wie WebScraper.io und ParseHub tun dies in der Regel nicht, was bedeutet, dass Sie auf geschützten Seiten blockiert werden.

- Was ist der Unterschied zwischen einer Scraping-API und einem No-Code-Scraper?

Eine Scraping-API (wie ScraperAPI) gibt rohes HTML zurück, das Sie dann mit Ihrem eigenen Code parsen. Ein No-Code-Scraper (wie Octoparse) übernimmt sowohl das Abrufen der Seite als auch das Extrahieren bestimmter Datenfelder über eine visuelle Oberfläche — in keinem Schritt ist Code erforderlich.

- Ist Web Scraping legal?

Das Web Scraping von öffentlich zugänglichen Daten ist im Allgemeinen legal, aber die Einzelheiten hängen von den Nutzungsbedingungen der Website, der Art der gesammelten Daten und der Gerichtsbarkeit ab. Vorschriften wie die DSGVO schränken das Scraping personenbezogener Daten in der EU ein. Überprüfen Sie immer die robots.txt und die Nutzungsbedingungen einer Seite und holen Sie für sensible Projekte rechtlichen Rat ein.

- Wie viel kostet Web Scraping?

Die Kosten reichen von kostenlos (kostenloser Plan von Octoparse, Chrome-Erweiterung von WebScraper.io) bis hin zu Tausenden pro Monat (Enterprise-Pläne von Bright Data, Managed Services wie PromptCloud). Für die meisten mittelständischen Unternehmen decken $100–$300/Monat das Scraping auf Produktionsniveau mit einem Self-Service-Tool ab. Der Standard-Plan von Octoparse für $119/Monat ist ein häufiger Startpunkt.