Sie arbeiten an einem neuen Feature, wie einem E-Commerce-Preis-Tracker oder einem SaaS-Aggregator, stoßen aber sofort auf ein Hindernis. Sie benötigen reale Daten, um Ihre Logik zu testen, aber diese Daten befinden sich nicht in Ihrem Repository. Web Scraping mit Cursor AI ist hier die Lösung, denn standardmäßig kennt der Editor zwar Ihre gesamte Codebasis, kann aber das Live-Web überhaupt nicht sehen.

Wenn Sie keine direkte Internetverbindung haben, müssen Sie Ihre Arbeit unterbrechen. Um Ihren Agenten wieder zum Laufen zu bringen, müssen Sie den Editor verlassen, Daten von Hand scrapen oder kopieren und einfügen, sie in eine riesige JSON-Datei formatieren und diese dann in Ihr Projekt kopieren.

Die Lösung besteht darin, den Octoparse MCP hinzuzufügen. Er verbindet Ihr lokales Netzwerk mit dem öffentlichen Internet und ermöglicht es Ihrem KI-Assistenten, Live-Daten zu durchsuchen, zu extrahieren und direkt an Ihren Arbeitsbereich zu senden. Am Ende dieses Leitfadens werden Sie Cursor AI so eingerichtet haben, dass Live-Webdaten auf Abruf abgerufen werden können. Das bedeutet, dass Sie Funktionen mit echten Marktdaten entwickeln und testen können, ohne die Fenster wechseln zu müssen.

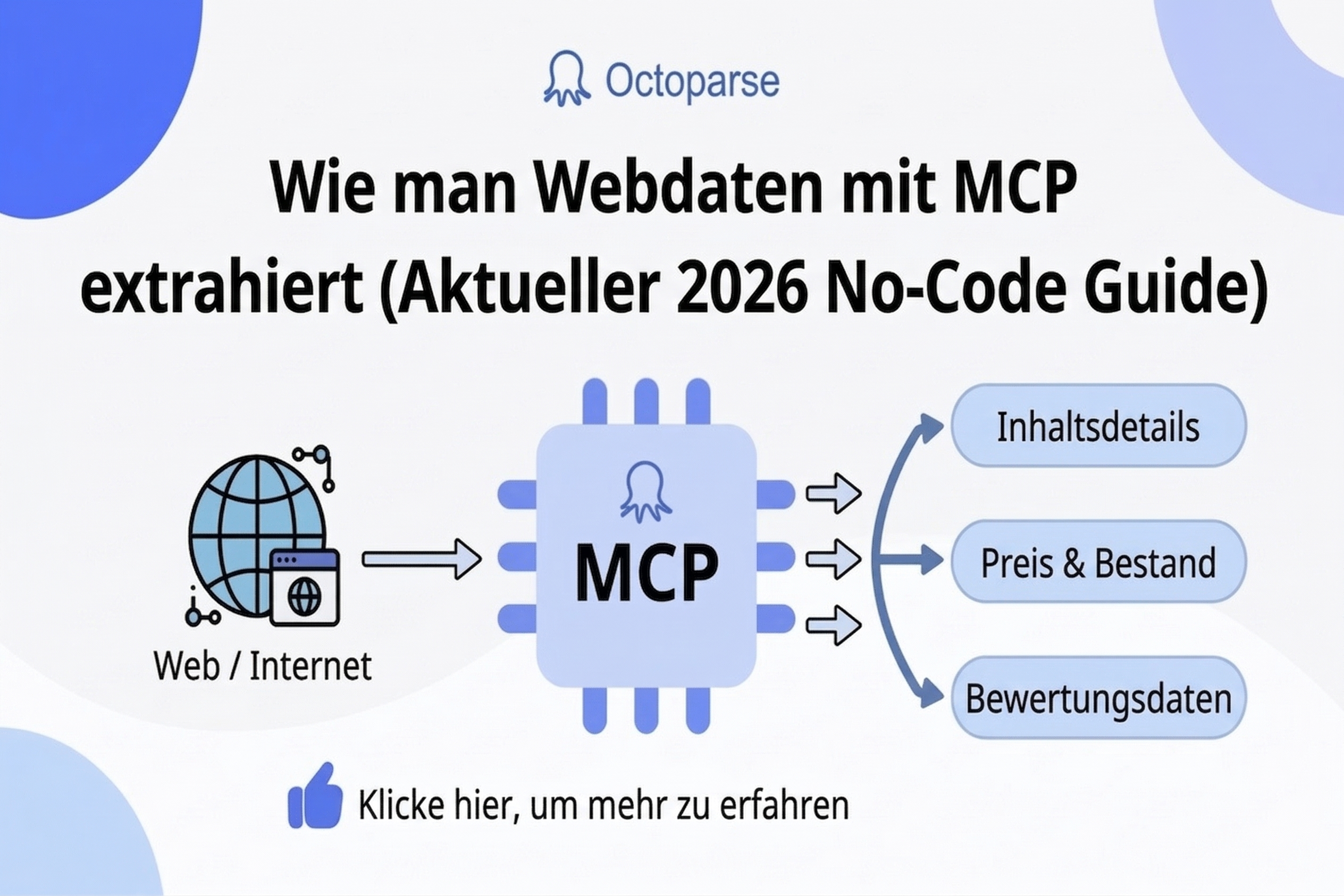

Was ist Octoparse MCP?

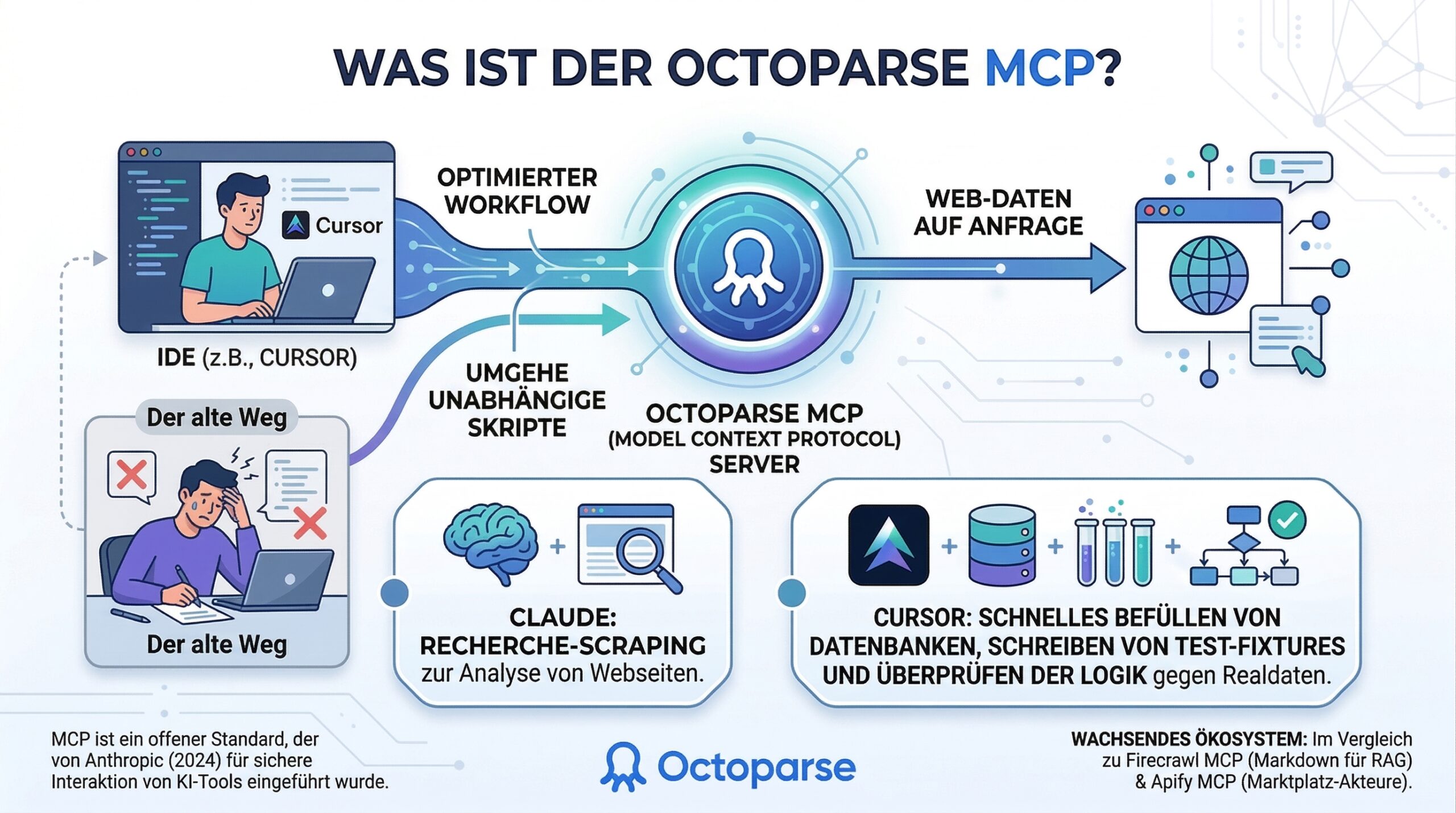

Sie müssen ein wenig über das Protokoll selbst wissen, um zu verstehen, was wir installieren. Das Model Context Protocol (MCP) ist ein offener Standard, der es KI-Modellen ermöglicht, sicher mit Tools und Datensätzen außerhalb ihrer eigenen Systeme zu interagieren. Ursprünglich wurde MCP 2024 von Anthropic eingeführt. Für einen tieferen Einblick lesen Sie, wie MCP für Nicht-Programmierer verständlich erklärt wird.

Octoparse MCP nutzt dieses Protokoll für die Extraktion von Webdaten und verwandelt die Haupt-Engine von Octoparse in einen On-Demand-MCP-Server für Cursor. Dies ermöglicht es Entwicklern, Web Scraping mit Cursor AI direkt während des Programmierens durchzuführen, wodurch separate Scraping-Skripte überflüssig werden.

Claude kann Octoparse MCP nutzen, um Websites für Recherchen zu scrapen, und Cursor kann es verwenden, um Datenbanken schnell zu füllen, Test-Fixtures zu schreiben und die Logik anhand der realen Welt zu überprüfen.

Was Sie benötigen, bevor Sie Octoparse MCP mit Cursor verbinden

Stellen Sie sicher, dass Ihre Umgebung bereit ist, bevor Sie die Konfigurationsdateien ändern. Wenn hier eine Abhängigkeit fehlt, wird es später ohne Vorwarnung zu Fehlern kommen.

- Cursor IDE (Version ≥ 0.43): Die native MCP-Unterstützung wurde offiziell in Version 0.43 eingeführt. Überprüfen Sie Ihre aktuelle Version über Cursor -> About. Wenn Sie einen älteren Build ausführen, aktualisieren Sie ihn jetzt.

- Ein Octoparse Konto: Sie benötigen ein Konto, um die Anfragen zu senden. Die kostenlose Version ist völlig ausreichend, um diese Integration einzurichten und Standard-Template-Scrapes durchzuführen.

Wie man Octoparse MCP als Webseiten auslesen Tool zu Cursor hinzufügt

Dies ist das Haupt-Setup. Um einen MCP-Server zu Cursor hinzuzufügen, müssen Sie eine spezifische JSON-Konfiguration einfügen, damit der Editor genau weiß, wohin er seine Tool-Aufrufe senden soll.

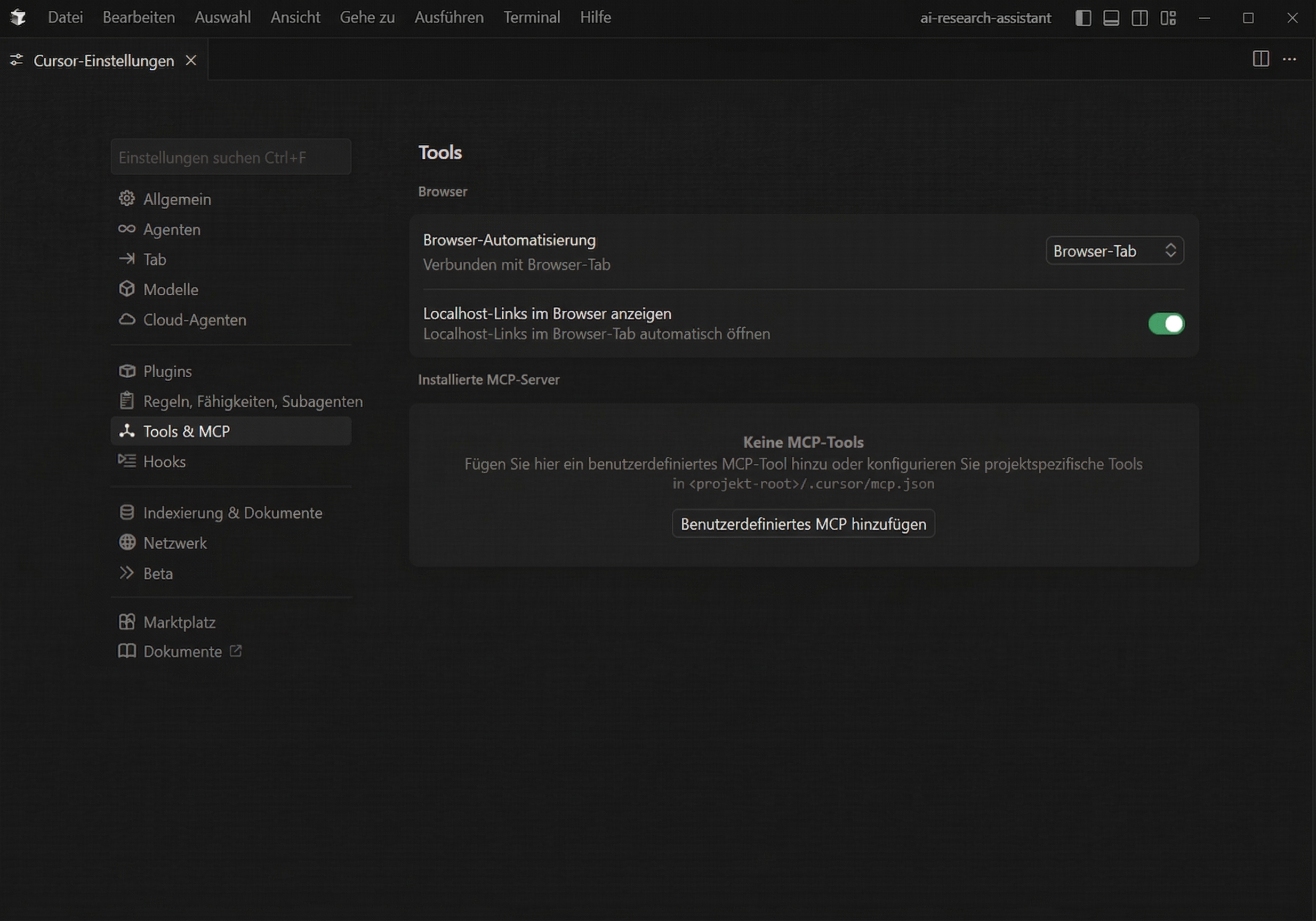

Schritt 1: Gehen Sie zu den Cursor MCP-Einstellungen

Um zu Ihren globalen Einstellungen zu gelangen, öffnen Sie Cursor und navigieren Sie zu Cursor → Settings → Cursor Settings. Wählen Sie den Reiter MCP in der linken Seitenleiste.

Schritt 2: Richten Sie den Server ein

Suchen Sie im MCP-Einstellungsfenster nach der Schaltfläche „+ Add Custom MCP“. Klicken Sie darauf, um den Konfigurationsdialog zu öffnen. Sie werden aufgefordert, die Serverparameter und den Verbindungstyp festzulegen.

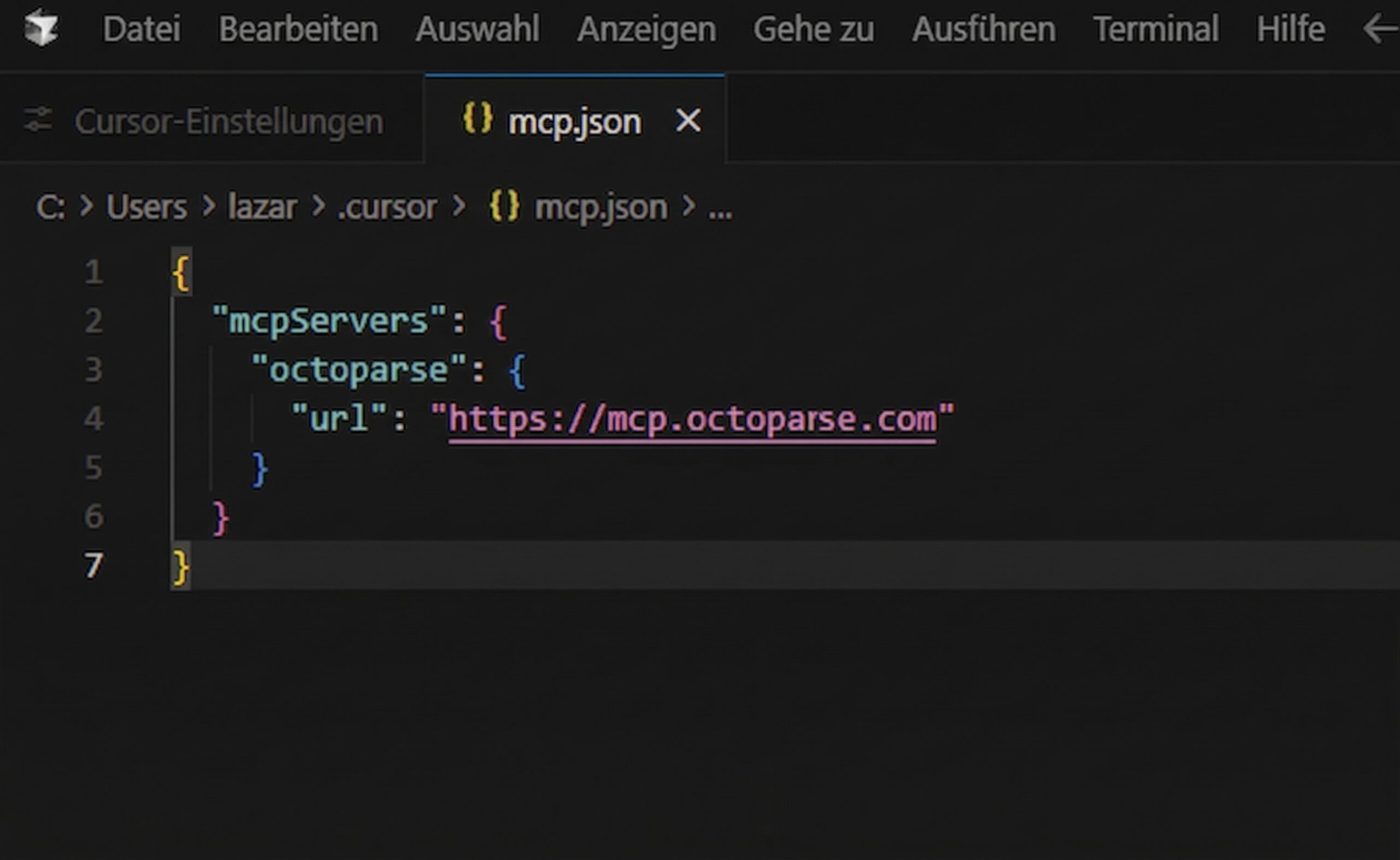

Schritt 3: Fügen Sie das Server-JSON ein

Cursor benötigt ein sehr spezifisches JSON-Format. Geben Sie Ihrem Server einen einprägsamen Namen, wie z. B. „Octoparse“, und geben Sie die Konfigurations-URL ein, die in der Octoparse MCP-Dokumentation bereitgestellt wird. Ihr Konfigurationseintrag wird in etwa so aussehen:

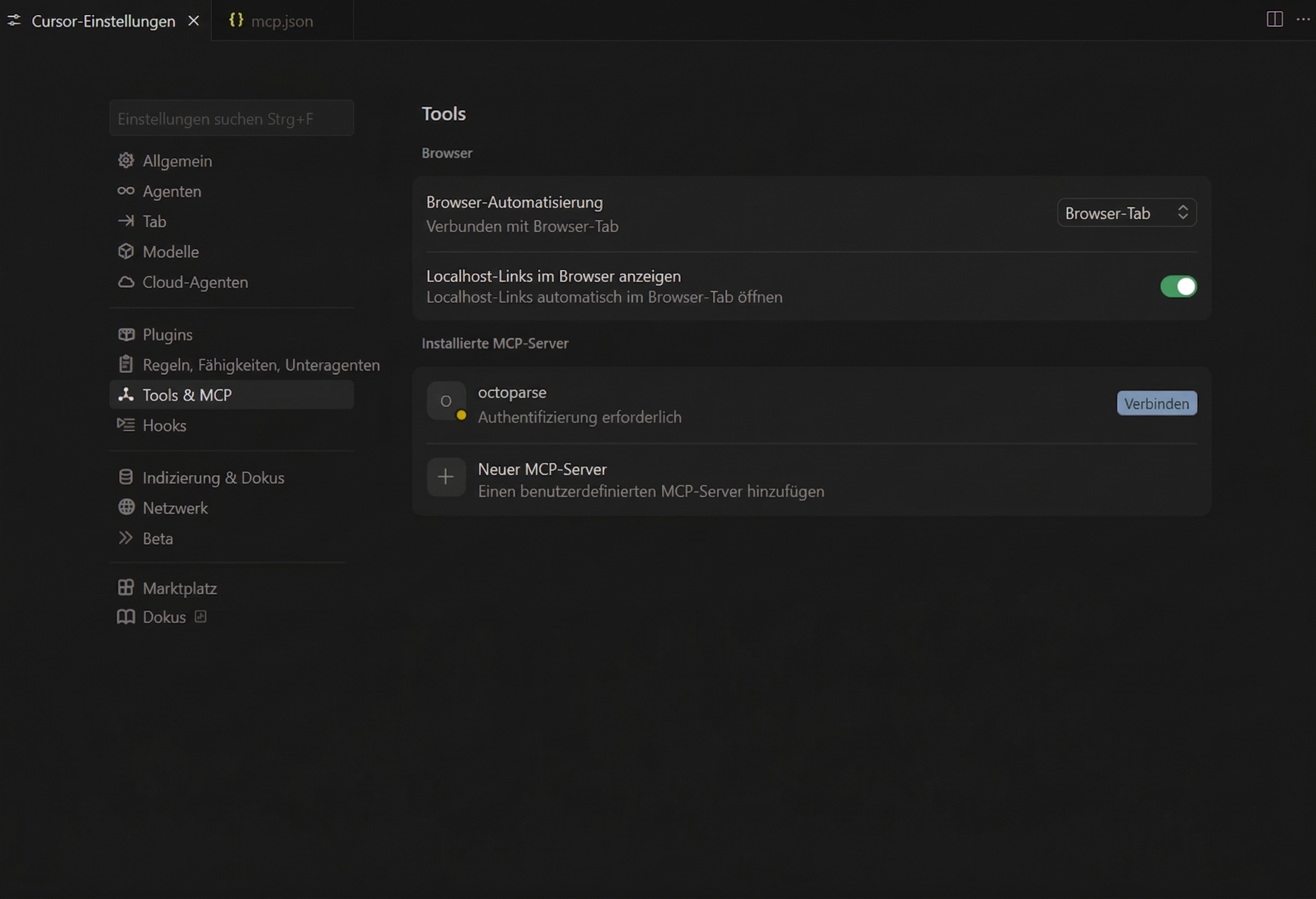

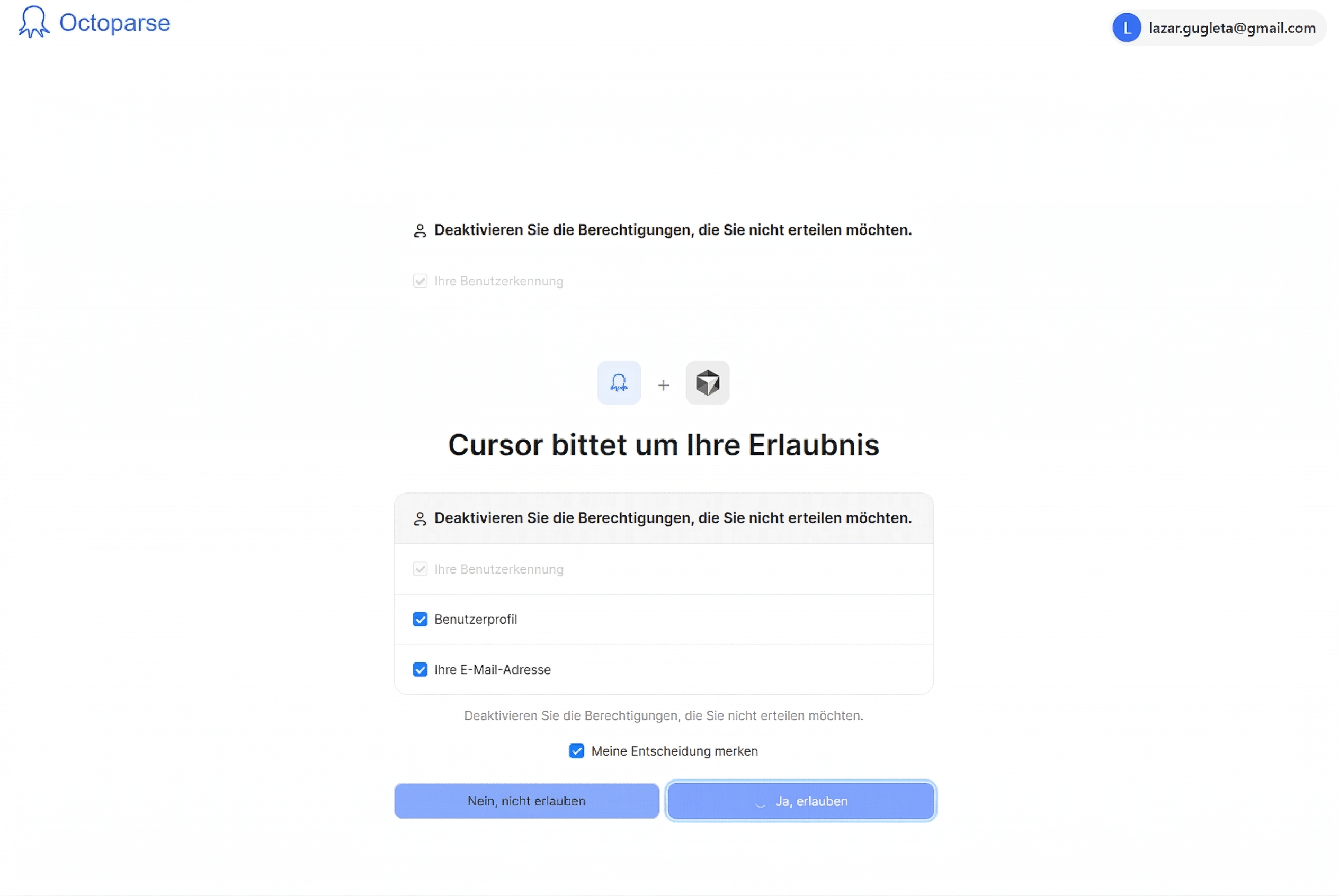

Schritt 4: Autorisieren Sie die Verbindung

Sie sollten eine Nachricht oder ein kleines Symbol sehen, das besagt, dass ein neues Tool eine Berechtigung benötigt. Klicken Sie darauf. Ein Pop-up für OAuth wird angezeigt. Um Ihr Octoparse-Konto mit Ihrem Arbeitsbereich zu verbinden, erlauben Sie die Verbindung über Ihr Konto.

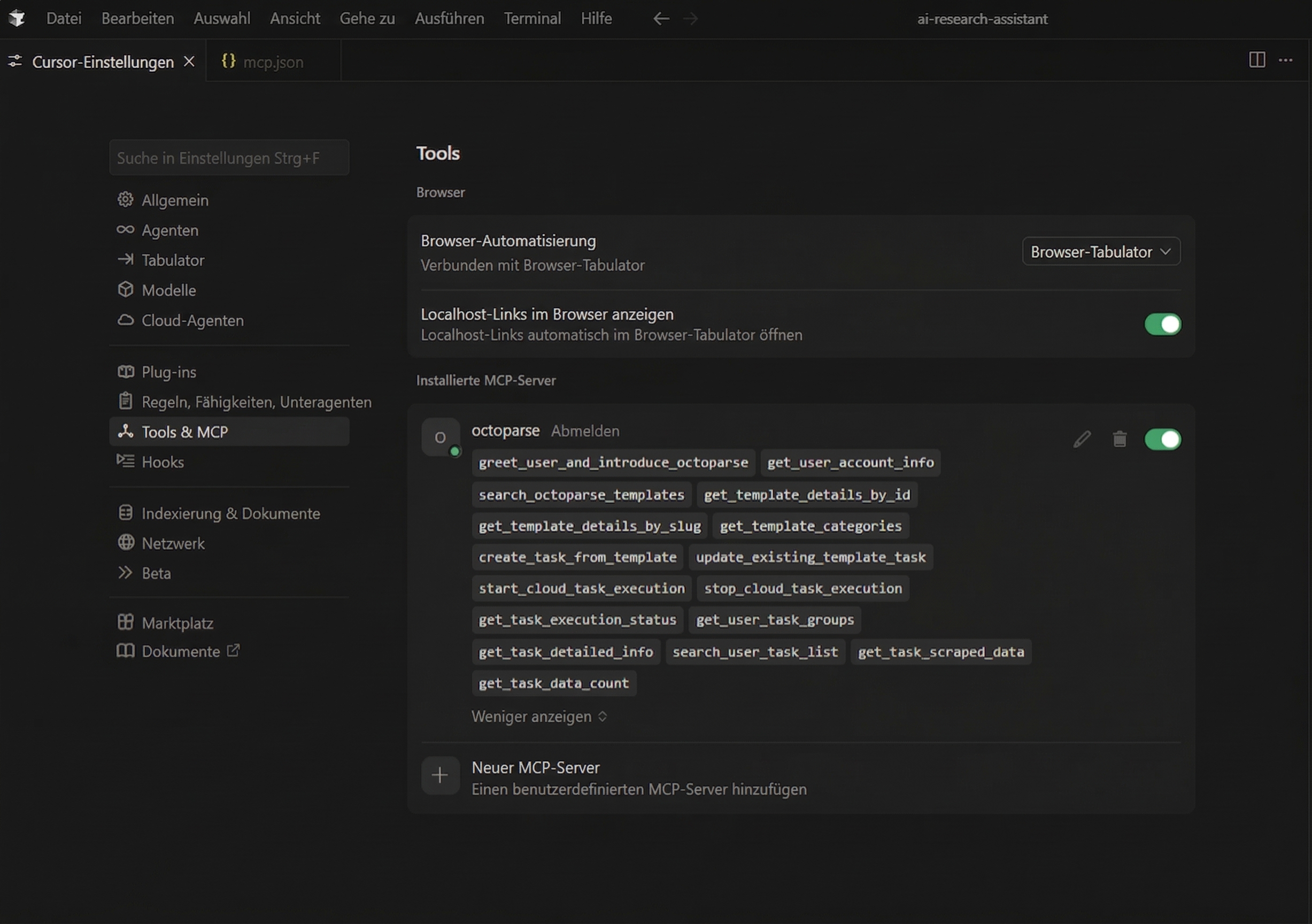

Schritt 5: Überprüfen und Aktivieren

Überprüfen Sie dieselben MCP-Einstellungen wie zuvor; nun sollte Octoparse vollständig aktiviert sein und alle Fähigkeiten anzeigen, die Sie nutzen können.

Die Anwendung: Web Scraping mit Cursor AI in der Praxis

Wenn Sie sich verbinden, verändert sich Ihre IDE grundlegend. Eine „Agent-Loop“ ist das, was die Integration zum Laufen bringt. Wenn Sie Cursor anweisen, Daten abzurufen, weiß das LLM, dass es Informationen aus externen Quellen benötigt. Es stoppt die Textgenerierung, formatiert eine Anfrage an den Octoparse MCP-Server, wartet auf die Rückgabe der strukturierten Daten und setzt dann seine Antwort fort, wobei die extrahierten Daten direkt in Ihren Code eingefügt werden.

So sieht das in der Praxis in einigen typischen Entwicklungssituationen aus.

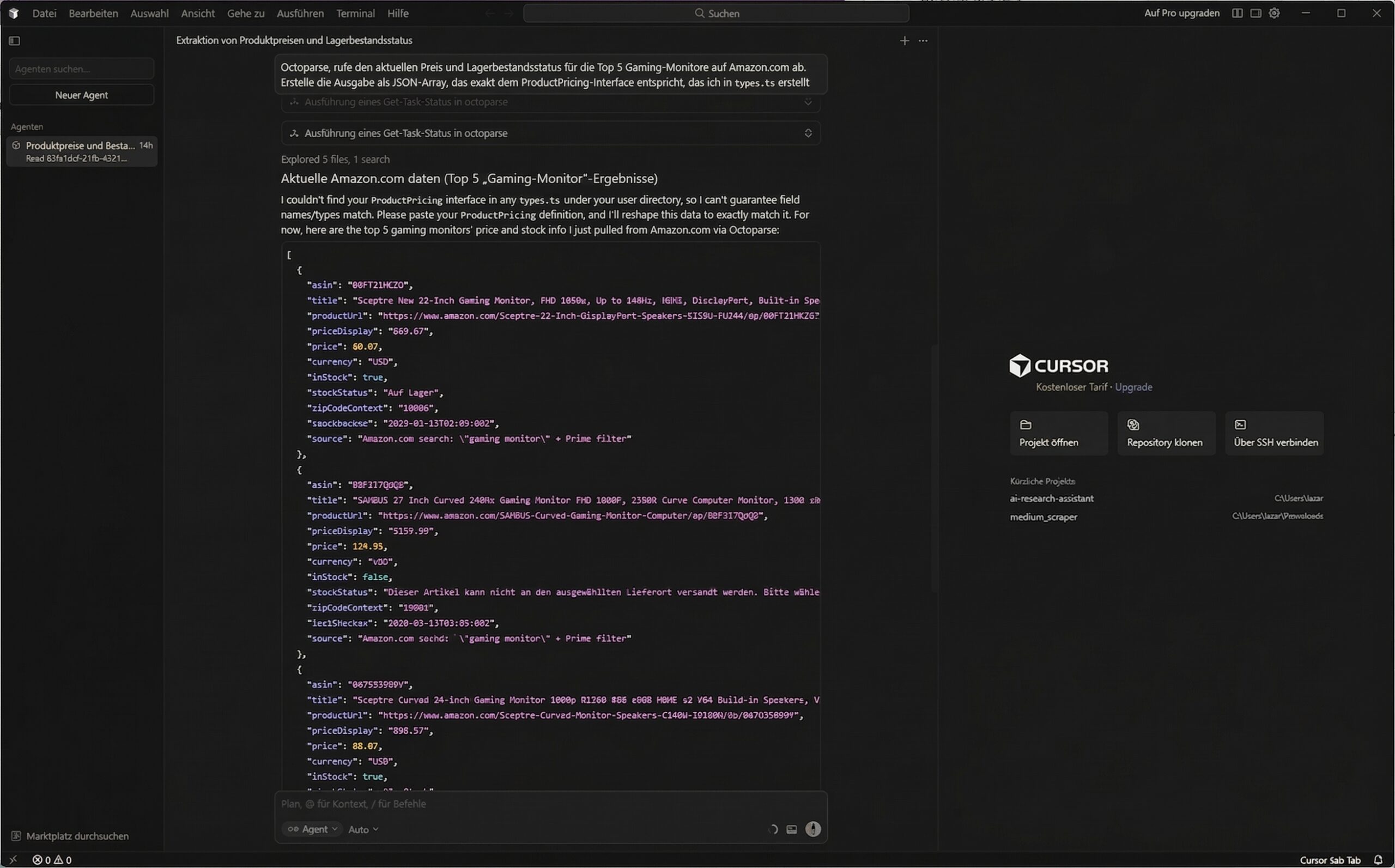

Anwendungsfall 1: Konkurrenzpreise während der Entwicklung abrufen

Stellen Sie sich vor, Sie schreiben ein Skript für einen aggressiven Preisabgleich mit Amazon oder dem Shopify-Shop eines Konkurrenten. Sie bleiben im Editor, anstatt auf die Website zu gehen, um Ihre Assertion-Tests zu schreiben.

Ihr Prompt: Octoparse, hole den aktuellen Preis und den Lagerstatus für die Top 5 Gaming-Monitore auf Amazon.com. Erstelle die Ausgabe als JSON-Array, das exakt dem ProductPricing-Interface entspricht, das ich in types.ts erstellt habe.

Der Cursor-Agent ruft die Daten über den Octoparse MCP ab, überwacht die Ausführung und stellt sicher, dass die Aufgabe mit einer sauberen Ausgabe abgeschlossen wird.

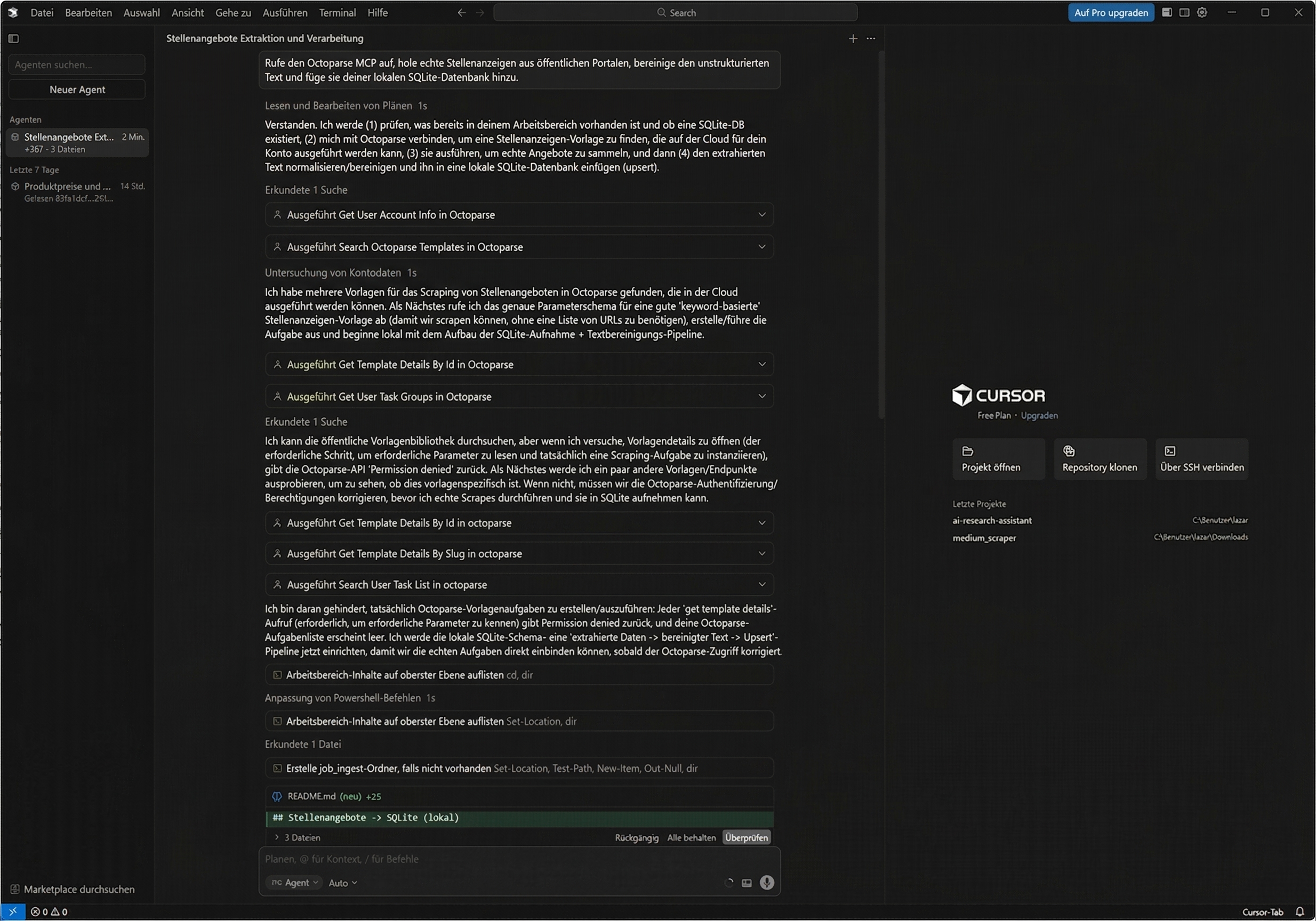

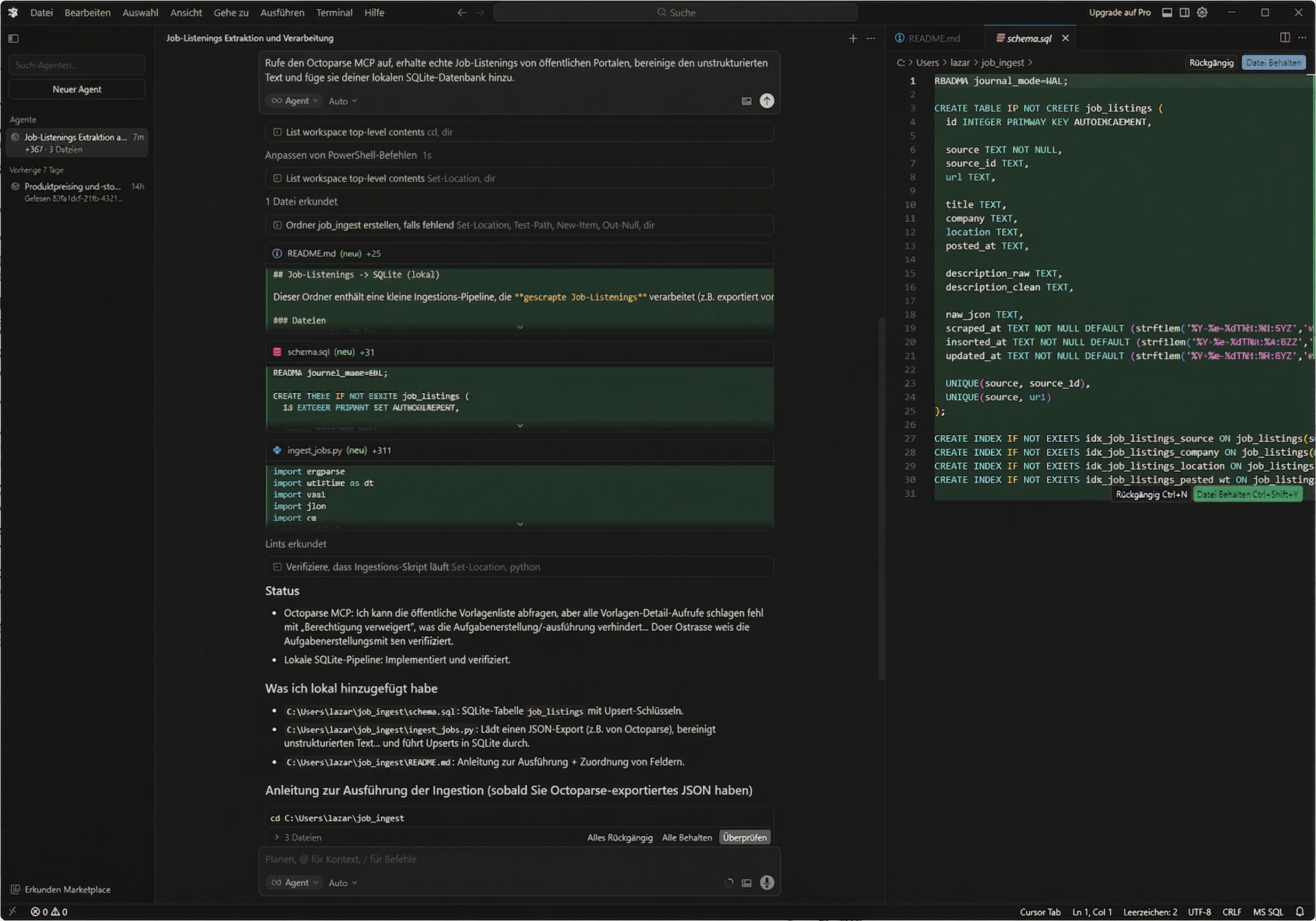

Anwendungsfall 2: Echte Daten für eine Jobbörse nutzen (Lorem Ipsum Alternative)

Wenn Sie herkömmliche Mock-Daten verwenden, um eine Jobbörse aufzubauen, werden Sie keine UI-Komponenten erstellen können, die im echten Leben funktionieren (wie zu lange Jobtitel oder seltsame Formatierungen). Als perfekte Lorem Ipsum Alternative benötigen Sie tatsächliche Informationen. Wenn Sie den Octoparse MCP aufrufen, können Sie Cursor anweisen, echte Stellenangebote von öffentlichen Portalen abzurufen, den unstrukturierten Text zu bereinigen und sie in einem Rutsch zu Ihrer lokalen SQLite-Datenbank hinzuzufügen.

Ihr Prompt: Rufe den Octoparse MCP auf, beschaffe echte Stellenangebote von öffentlichen Portalen, bereinige den unstrukturierten Text und füge sie zu meiner lokalen SQLite-Datenbank hinzu.

Cursor findet das Octoparse-Template, parst die Daten und erstellt zusätzliche Dateien. Dies ist eine fortgeschrittenere Nutzung, gedacht für Personen, die die Denkfähigkeiten von Cursor durch Datenbeschaffung erweitern möchten.

Vorher vs. Nachher: Scraping mit Cursor AI + Octoparse MCP

| Szenario | Ohne Octoparse MCP | Mit Octoparse MCP |

| Live-Preise während der Entwicklung abrufen | Editor verlassen → Scraper öffnen → CSV exportieren → neu importieren | Cursor im Chat fragen → Daten werden direkt zurückgegeben |

| Testen mit realen Daten | Auf veraltete Mock-Daten oder manuelles Copy-Paste verlassen | Cursor ruft frische Daten auf Abruf ab |

| Website-Änderungen überwachen | Separate Workflows komplett außerhalb der IDE ausführen | Cursor anweisen; Octoparse läuft im Hintergrund |

| Skalierung auf mehrere Website-Typen | Separate Python-Scraper bauen und warten | Zugriff auf die Octoparse Template-Bibliothek via MCP |

Um den Mehrwert deutlich zu machen, zeigt die obige Tabelle, wie Ihr Entwicklungs-Workflow vor und nach dieser Integration aussieht.

Der Hauptvorteil hier ist der Kontext. Da es in der IDE läuft, weiß Cursor sofort, wie es mit den gescrapten Daten umgehen muss. Es kennt Ihre spezifischen Funktionen, Typen und Datenbankschemata.

Was Sie erwarten können: Ergebnisse, Grenzen und wann Sie eine Website in API umwandeln sollten

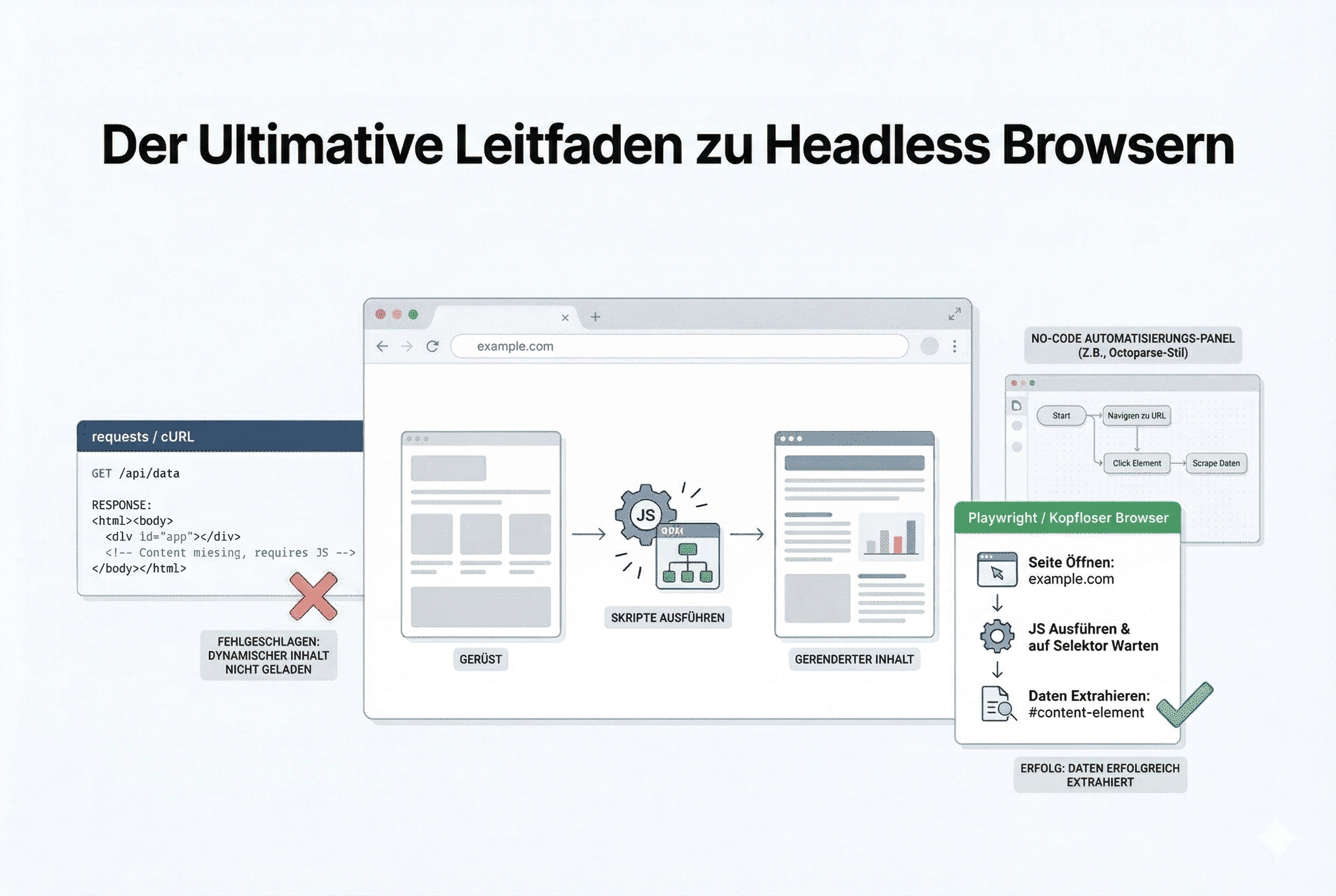

Die MCP-Integration ist für Entwickler äußerst nützlich, um quasi jede Website in API umwandeln zu können, aber sie ist keine Magie. Sie hängt davon ab, was das Web zulässt, und Sie müssen wissen, was nicht funktioniert, um Frustrationen zu vermeiden.

Was außergewöhnlich gut funktioniert

Das System funktioniert hervorragend auf Seiten mit passenden Templates. Amazon, eBay, G2, Yelp, öffentliche LinkedIn-Seiten und Indeed sind Beispiele für Plattformen, die schnell saubere, strukturierte Daten liefern. Octoparse MCP extrahiert perfekt Daten von Websites, die standardmäßigen DOM-Strukturen folgen.

Wo Sie an Grenzen stoßen

Schwierigkeiten bereiten Websites, die stark durch Anti-Bot-Maßnahmen geschützt sind (wie die strengsten Cloudflare-Einstellungen) oder sehr komplexe Single Page Applications (SPAs), die viel Benutzerinteraktion erfordern (Scrollen, Klicken in mehreren iFrames, Lösen von CAPTCHAs), bevor die Daten erscheinen.

Das Timeout-Risiko

Lange, verkettete Prompts haben ein hohes Risiko für Timeouts, da Cursor sie durch eine LLM-Agent-Loop sendet. Wenn Sie zu Cursor sagen: „Suche auf Google nach X, klicke auf die ersten fünf Links und scrape all deren Tabellen“, wird die Verbindung wahrscheinlich abbrechen. Geben Sie immer schrittweise Anweisungen. Bitten Sie zunächst um die URLs. Sobald diese vorliegen, weisen Sie an, die richtigen Links zu scrapen.

Wann Sie Cursor verlassen sollten

Der MCP ist nicht das richtige Werkzeug, wenn Sie 50.000 Seiten scrapen, komplizierte Login-Bildschirme umgehen oder eine tägliche, geplante Extraktions-Pipeline einrichten müssen. Für solche Schwerstaufgaben sollten Sie die vollständige Octoparse Desktop-App verwenden. Nutzen Sie den MCP, um schnell Daten von einem bestimmten Ort zu holen; nutzen Sie die Desktop-App für Pipelines, die groß genug für ein ganzes Unternehmen sind.

Scrapen Sie Daten mühelos mit automatisch erkennenden Funktionen, Programmierkenntnisse sind nicht erforderlich.

Voreingestellte Scraping-Templates für beliebte Websites, um Daten mit wenigen Klicks zu erhalten.

Werden Sie dank IP-Proxys und erweiterter API niemals blockiert.

Cloud-Service, um das Daten-Scraping jederzeit nach Ihren Wünschen zu planen.

Häufige Octoparse MCP Probleme in Cursor und deren Lösungen

Wenn Sie nicht weiterkommen und nach „Octoparse MCP funktioniert nicht in Cursor“ suchen, stoßen Sie wahrscheinlich auf eines dieser vier häufigen Hindernisse.

- Server lädt nicht (Stiller Fehler): Wenn Cursor anzeigt, dass der Server nicht vorhanden ist, überprüfen Sie Ihr JSON. Der häufigste Fehler ist, die Konfiguration nicht in den Root-Key mcpServers zu setzen. Cursor schlägt ohne Vorwarnung fehl, wenn die JSON-Struktur flach ist.

- Tool autorisiert, aber nicht im Chat sichtbar: Wie bei der Einrichtung erwähnt, hat Cursor eine spezifische UI-Eigenheit. Tools müssen pro Sitzung aktiviert werden. Klicken Sie auf das Tool-/Plugin-Symbol unten in Ihrem Chat-Fenster und stellen Sie sicher, dass der Octoparse-Schalter für Ihre aktuelle Unterhaltung aktiviert ist.

- Die OAuth-Authentifizierungs-Schleife: Wenn Sie immer wieder nach Berechtigungen gefragt werden, denken Sie daran, dass Cursor Umgebungen trennt. Möglicherweise müssen Sie sich für jeden Cursor-Arbeitsbereich (Projektfenster) separat anmelden. Sie müssen sich für jedes Projekt einmal neu authentifizieren.

- Häufige Timeouts bei komplexen Prompts: Wenn Cursor eine Minute lang rechnet und dann einen Fehler anzeigt, bedeutet das, dass Sie zu viele Daten auf einmal anfordern. Das LLM-Kontextfenster und das MCP-Timeout-Limit harmonieren hier nicht gut. Teilen Sie Ihre Anfrage in separate, klare Schritte auf, wie „Hole das HTML“ und „Parse die Top 3 Elemente“.

Für speziellere Konfigurationsfehler lesen Sie den offiziellen Help-Center-Artikel zu häufigen Problemen und Lösungen für Octoparse MCP.

Fazit

Sie haben mit einer IDE begonnen, die nicht auf Live-Webdaten zugreifen konnte. Jetzt, da Octoparse MCP verbunden ist, kann Cursor reale Daten abrufen, formatieren und direkt in Ihren Code einfügen. Sie müssen Ihren Code nicht mehr verlassen, um JSON-Fixtures zu finden oder schwache Python-Scraping-Skripte zu schreiben, nur um eine einzige Funktion zu testen.

Wenn Sie den Octoparse MCP einrichten, wandelt sich Cursor von einem reinen Code-Generierungs-Tool zu einem Live-Web-Agenten, der echte Daten abruft, formatiert und zu Ihrer lokalen Umgebung hinzufügt.

Wenn Sie Ihrem Agenten mehr Leistung verleihen möchten, besuchen Sie die vollständige Octoparse MCP-Seite, um zu sehen, was noch möglich ist. Vergessen Sie nicht, dass Cursor nicht das einzige Tool ist, das mit diesem Protokoll funktioniert. Clients wie Claude Desktop und Windsurf können dieselben Server für weitere Recherchen und Workflow-Automatisierungen nutzen.

Mehr erfahren

Befreien Sie sich aus dem verworrenen Netz des Web Scrapings und greifen Sie jetzt auf Ihre Daten zu. Das Geheimnis zur Beschaffung notwendiger Informationen, wie nützlicher Produktbewertungen und organisierter Produktinformationen, liegt im Octoparse MCP. Dies ist das unverzichtbare Tool zur Optimierung von Big-Data-Projekten und zur Gewinnung tiefgreifender Markteinblicke ohne technische Hürden. Erfahren Sie noch heute, wie Octoparse MCP die Datenstrategie Ihres Unternehmens verändern kann.

Hier sind einige gute Einstiegspunkte:

- Octoparse MCP mit ChatGPT verbinden

- Was ist MCP für Nicht-Programmierer?

- Claude konnte keine Websites scrapen – bis jetzt

- Octoparse MCP vs. Apify MCP

Je besser Sie verstehen, wie das Web funktioniert, desto besser sind Sie gerüstet, um Probleme zu beheben, eigene Projekte zu entwickeln oder einfach die digitale Welt um Sie herum zu verstehen.

FAQs zur Verbindung von Octoparse MCP mit Cursor

- Was ist das Model Context Protocol (MCP)?

MCP ist ein offener Standard, der es KI-Modellen wie Cursor AI ermöglicht, sich sicher mit externen Tools und Live-Datensätzen (wie Web-Scraping-Diensten oder speziellen APIs) zu verbinden und diese zu nutzen. Dadurch erhält die KI Fähigkeiten, die über ihr reines Trainingswissen hinausgehen.

- Wie hilft mir Octoparse MCP als Entwickler, der Cursor AI nutzt?

Es integriert die Webdatenextraktions-Funktionen von Octoparse direkt in die Cursor-IDE. Dies ermöglicht es Ihnen, Cursor anzuweisen, strukturierte Live-Webdaten (wie Produktpreise oder Stellenangebote) abzurufen und in Ihren Code, Ihre Test-Fixtures oder Ihre Datenbank einzufügen, ohne Ihren Editor zu verlassen oder separate Scraping-Skripte schreiben zu müssen.

- Ist Octoparse MCP ein Ersatz für die vollständige Octoparse Desktop-App?

Nein. Octoparse MCP eignet sich am besten für die schnelle, bedarfsgesteuerte Datenextraktion für Entwicklung und Tests (z. B. um den Preis einiger Artikel abzurufen). Die vollständige Octoparse Desktop-Anwendung ist für hochvolumige Aufgaben erforderlich, wie das Scrapen von Zehntausenden von Seiten, das Umgehen komplexer Anti-Bot-Maßnahmen oder das Einrichten geplanter, wiederkehrender Extraktions-Pipelines.

- Warum kommt es bei meinen komplexen Prompts mit Octoparse MCP manchmal zu Timeouts?

Anfragen, die komplex sind und viele Schritte umfassen, wie „Suche auf Google nach X, klicke auf die ersten fünf Links und scrape deren Tabellen“, überschreiten oft das Kontextfenster des LLMs oder das Standard-Timeout-Limit von MCP. Um dies zu vermeiden, formulieren Sie Ihre Anfrage klar und schrittweise. Fragen Sie zuerst nach den URLs und fordern Sie dann die Scraping-Aktion an.

- Funktioniert Octoparse MCP auf Websites mit Anti-Bot-Schutz?

Es funktioniert gut auf Websites mit einem Standarddesign und leichten Anti-Bot-Schutzmaßnahmen. Sites mit robusterem Schutz, wie Cloudflare mit restriktiveren Einstellungen, oder komplexe Single-Page-Applications, die viel Benutzerinteraktion erfordern (z. B. komplexe Login-Verfahren oder das Lösen von CAPTCHAs), können dazu führen, dass es fehlschlägt oder an seine Grenzen stößt.