Wenn Sie langfristige Twitter-Daten wie die Stimmung der Konkurrenz, historische Tweets mit Zeitstempeln, die Jahre zurückreichen, und eine kontinuierlich laufende Pipeline benötigen, stehen Sie vor der Wahl zwischen Twitter Scraping und den offiziellen Twitter-APIs.

Die API ist zuverlässig, kann aber Tausende von Dollar pro Monat kosten, während das Scraping günstig, aber anfällig ist und oft von IP-Sperren sowie ständigen Ausfällen geplagt wird.

Dieser Leitfaden behandelt das Hauptproblem, mit dem Datenexperten und Unternehmen derzeit konfrontiert sind: Wie hoch die Kosten sind im Vergleich dazu, wie sehr man den Daten vertrauen kann.

Wir wollen nicht nur einmalig Daten exportieren. Wir betrachten die langfristige Überwachung von Daten: die Fähigkeit, die Daten sechs, zwölf oder vierundzwanzig Monate lang fehlerfrei zu beobachten.

Egal, ob Sie ein Programmierer sind, der über ein Python-Skript für Twitter Scraping nachdenkt, oder ein Vorgesetzter, der sich Unternehmenstools ansieht – dieser Leitfaden schlüsselt die tatsächlichen Kosten, Gefahren und die langfristige Haltbarkeit jedes Ansatzes auf, damit Sie die Option wählen können, die auf Dauer wirklich funktioniert.

Kurze Antwort

Für das langfristige Monitoring von Twitter (X) bietet die offizielle API die höchste Zuverlässigkeit, jedoch zu unerschwinglichen Kosten, während DIY-Scraping günstiger, aber instabil und ressourcenintensiv ist.

Für die meisten Unternehmen bieten No-Code-Scraping-Tools wie Octoparse das beste Gleichgewicht aus Kosten, Zuverlässigkeit und Skalierbarkeit, was sie zur praktischsten Lösung macht, um historische und Echtzeit-Tweet-Daten kontinuierlich und ohne großen technischen Aufwand zu sammeln.

Twitter Scraping verstehen

Daten von Twitter abzurufen, das jetzt X heißt, ist eine automatisierte Datenerfassung zur Informationsgewinnung. Dies geschieht, indem simuliert wird, dass eine Person die Website oder die mobile App nutzt. Eine API liefert auf Anfrage Daten, die Computer leicht lesen können, wie z. B. JSON. Scraping ist anders. Es bedeutet, Webseiten zu laden und den HTML-Inhalt anzuzeigen. Dann nimmt es das, was sichtbar ist, und organisiert es in einem strukturierten Datenformat.

Gängige Scraping-Methoden

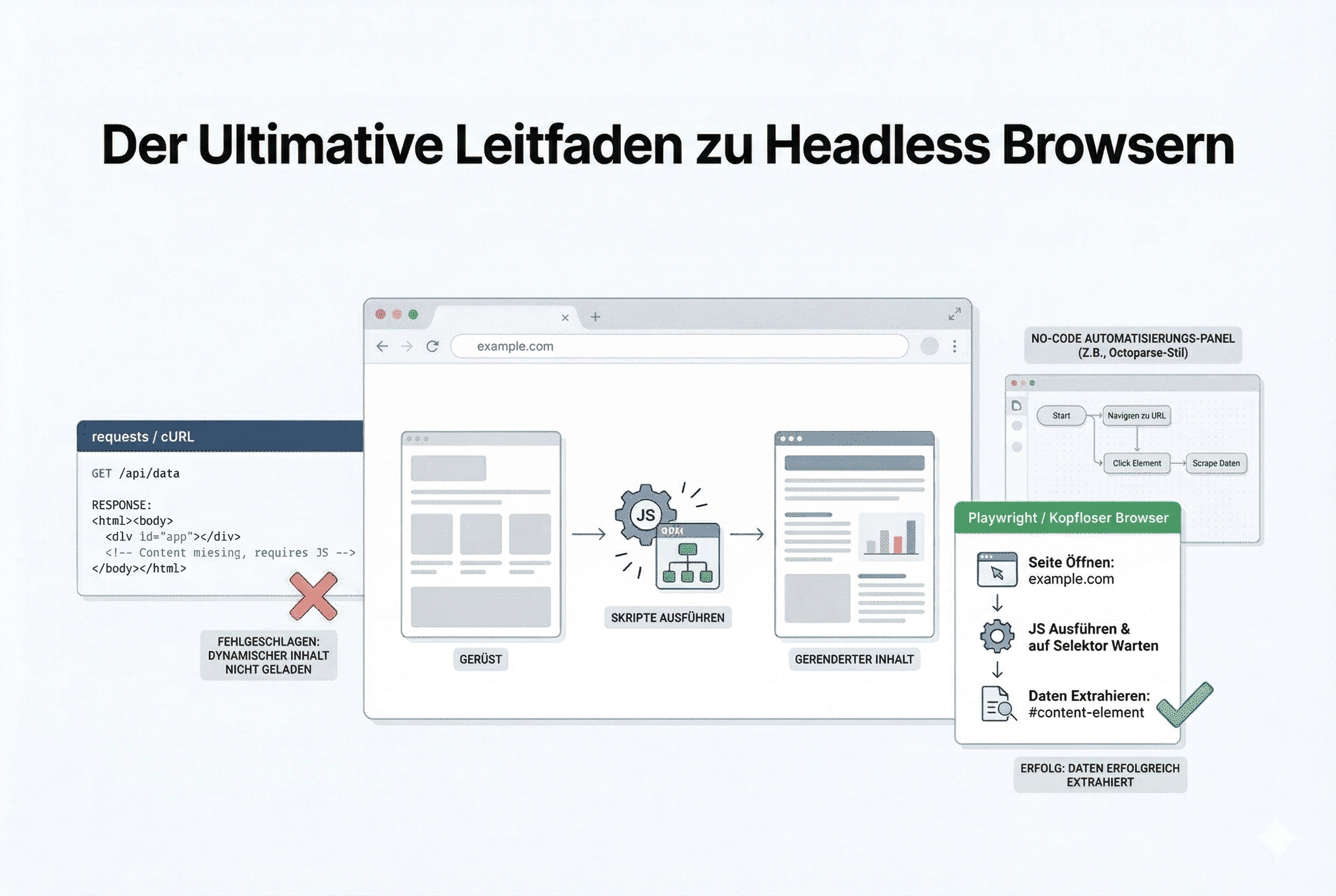

- Browser-Automatisierung mit Code: Selenium und Playwright sind Tools, die einen echten Webbrowser (wie Chrome oder Firefox) steuern. Sie können sich einloggen, durch eine Timeline navigieren, „Mehr anzeigen“ auswählen und den Text auf dem Bildschirm kopieren. Dies ist der am weitesten verbreitete Ansatz, da Twitter stark auf JavaScript angewiesen ist, um Inhalte anzuzeigen, was Standard-HTTP-Anfragen ineffizient macht.

- Abfangen von HTTP-Anfragen: Komplexere Scraper analysieren (Reverse-Engineering) die internen API-Aufrufe, die von der Twitter-Website an ihre eigenen Server gesendet werden. Durch die Emulation dieser „inoffiziellen“ Abfragen können Scraper Daten schneller abrufen, als wenn sie die gesamte visuelle Benutzeroberfläche laden würden.

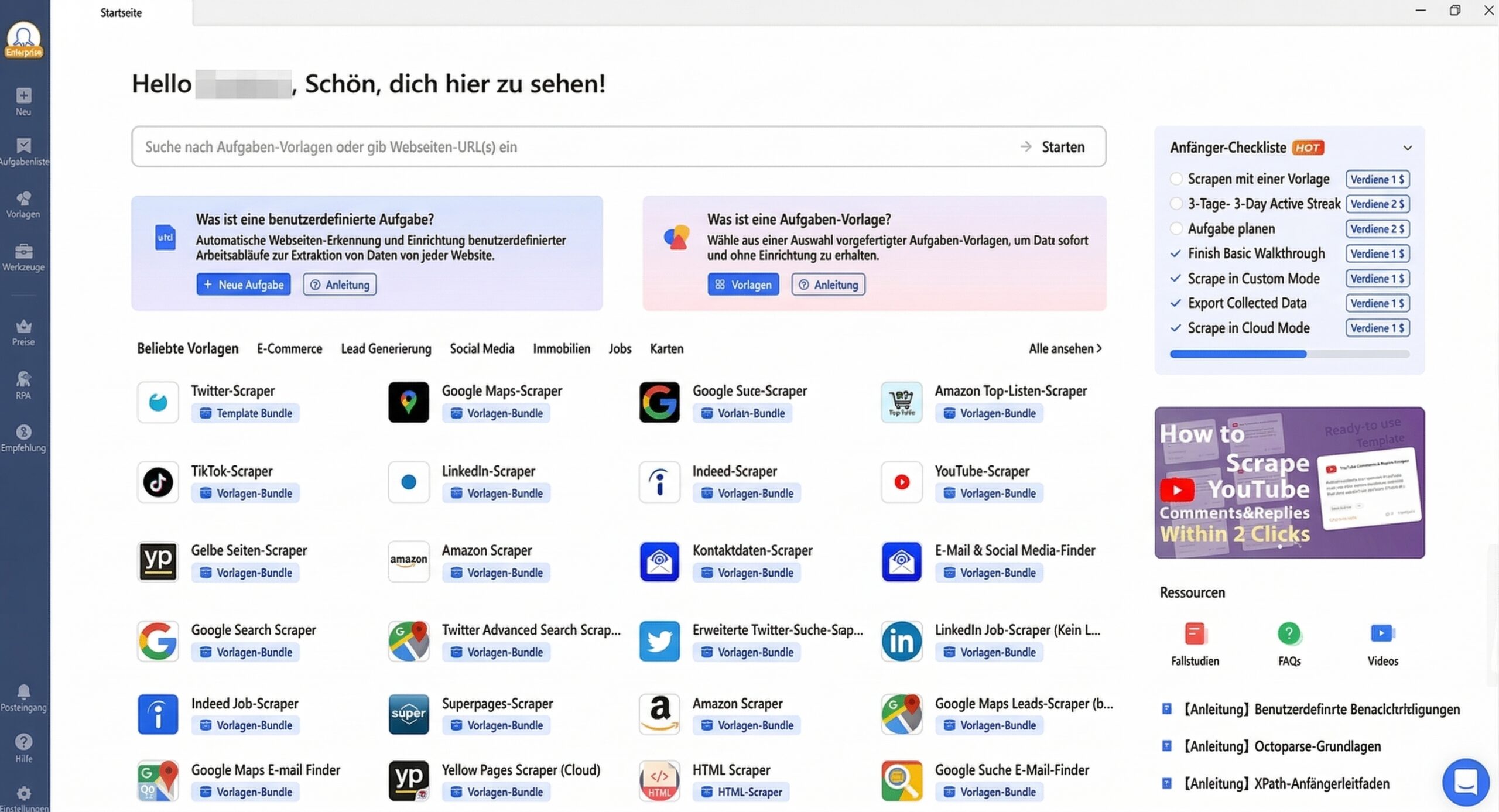

- Scraping-Tools von Drittanbietern: Vorgefertigte Software oder SaaS-Plattformen übernehmen die Komplexität für Sie und bieten eine einfache Benutzeroberfläche zur Eingabe einer URL und zum Herunterladen einer CSV-Datei. Als Alternative zum Python-Ansatz bieten No-Code-Tools wie Octoparse eine vollständige Browser-Automatisierung, insbesondere auf Websites wie Twitter.

Welche Daten können von Twitter gescrapt werden?

Praktisch alles, was für einen eingeloggten Benutzer sichtbar ist, kann gescrapt werden. Dazu gehören:

- Tweet-Inhalte wie Text, Hashtags, Cashtags und Emoticons.

- Medien wie Bilder und Video-Links.

- Engagement-Metriken, einschließlich der öffentlichen Anzahl von Likes, Retweets, Antworten und Aufrufen. Perfekt für die Wettbewerbsanalyse Social Media.

- Profilinformationen wie Follower-Zahlen, Biografien, Beitrittsdaten und Standorte.

- Metadaten wie Zeitstempel, Gerätequelle (falls zutreffend) und Tweet-IDs.

Technische Voraussetzungen für das Twitter Scraping

Ein Skript allein reicht für effektives Twitter Scraping nicht aus. Da X strenge Anti-Bot-Methoden einsetzt, benötigen Sie einen Technologie-Stack, der Folgendes umfasst:

- Proxy-Rotation: Die Nutzung eines Netzwerks von Residential-IP-Adressen als Proxy für Web Scraping, um zu verhindern, dass Ihr Scraper nach einigen hundert Anfragen blockiert wird.

- Headless-Browser sind Browser, die im Hintergrund laufen, um JavaScript auszuführen.

- Sitzungsmanagement: Die Verwaltung von Cookies und „Auth-Tokens“, um einen eingeloggten Zustand aufrechtzuerhalten, da Twitter mittlerweile für fast alle Informationen einen Login erfordert.

Zusammenfassend lässt sich sagen, dass Twitter Scraping direkten, ungefilterten Zugriff auf öffentliche Daten ohne die künstlichen Einschränkungen einer kostenlosen API-Stufe bietet, aber auch erhebliche technologische „Overheads“ verursacht, um den Zugang offen zu halten.

Twitter-APIs verstehen

Die Twitter-API (jetzt X-API) ist das offizielle Gateway für Entwickler, um auf die öffentlich zugänglichen Konversationsdaten der Plattform zuzugreifen. Sie ermöglicht es Apps, sich programmgesteuert mit Twitter zu verbinden und dabei die strengen Einschränkungen und Ratenlimits des Unternehmens einzuhalten.

Twitter-API-Preise: Das abgestufte Zugriffsmodell

Seit Ende 2023 hat sich die API-Struktur zu einem kostenintensiven, abgestuften Modell entwickelt, das klar zwischen Gelegenheitsnutzern und Unternehmen unterscheidet:

- Kostenlose Stufe (Free Tier): Dies ist im Wesentlichen eine „Nur-Schreiben“-Stufe. Sie erlaubt eine begrenzte Anzahl von Tweets (etwa 1.500 pro Monat), bietet jedoch keinen oder nur sehr begrenzten Zugriff auf Tweet-Daten. Für Monitoring-Zwecke ist sie nutzlos.

- Basis-Stufe (Basic Tier, 100 $/Monat): Entwickelt für Amateure und Prototypen. Sie erhalten eine bescheidene Lesebeschränkung (z. B. 10.000 Tweets pro Monat). Dieses Kontingent kann an einem einzigen Tag aufgebraucht sein, wenn eine Marke ihre Erwähnungen rund um die Uhr überwacht.

- Pro-Stufe (Pro Tier, 5.000 $/Monat): Dies ist der Einstiegspunkt für den kommerziellen Datenzugriff. Sie bietet rund 1 Million Tweets pro Monat und Zugriff auf die gesamte Archivsuche (historische Daten).

- Enterprise-Stufe (Enterprise Tier, 42.000+ $/Monat): Benutzerdefinierte Limits, spezieller Account-Support und höchste Zuverlässigkeit.

Umgang mit den Pro-Anfrage-Limits von Twitter

Die internen APIs und Timelines von Twitter erlegen strenge Limits auf, wie viele Daten Sie in einer einzigen Anfrage oder Scroll-Sitzung empfangen können. Wenn Sie einfach „nach unten scrollen“ oder eine große Abfrage abfeuern, werden Sie diese Limits lange vor Erreichen von drei Jahren Historie erreichen: Der Browser wird instabil, Anfragen laufen ins Timeout oder die Plattform hört unbemerkt auf, ältere Tweets zurückzugeben.

Um dies zuverlässig zu umgehen, versuchen die Twitter-Scraping-Vorlagen von Octoparse nicht, alles auf einmal zu erfassen. Stattdessen teilen sie die Aufgabe automatisch nach Datumsbereichen (z. B. Tag für Tag) auf, je nachdem, wie Sie den Job konfigurieren. Jeder Durchlauf konzentriert sich auf ein kleineres Zeitfenster, was:

- die Pro-Anfrage- und Timeline-Limits von Twitter respektiert,

- das Risiko von Abstürzen oder stillschweigenden Kürzungen verringert und

- die Menge an vollständigen historischen Daten maximiert, die Sie tatsächlich sammeln können.

Für Endbenutzer ist diese datumsbasierte Aufteilung unsichtbar: Sie definieren nur Ihren gesamten Zeitraum (wie „die letzten drei Jahre“), und Octoparse orchestriert im Hintergrund mehrere kleinere Durchläufe, um das bestmögliche Archiv von Tweets zusammenzustellen.

No-Code-Lösungen: Der dritte Weg für das Twitter-Daten-Monitoring

Für 90 % der Nutzer, wie Marketingagenturen, Forscher sowie kleine und mittlere Unternehmen, kommt die Entwicklung eines Python-Scrapers oder die Zahlung von 5.000 US-Dollar pro Monat nicht infrage. Dies hat zur Entstehung von No-Code-Scraping-Lösungen geführt.

Diese Lösungen verwalten die Infrastruktur (Proxyserver für das Scraping, Browser, Anti-Bot-Umgehung) und bieten eine einfache Benutzeroberfläche zum Abrufen der Daten. Sie fungieren effektiv als „Scraping-API“.

Der No-Code-Ansatz für Twitter Scraping:

Ein Web-Scraping-Tool mit visueller Benutzeroberfläche und Vorlagen. Sie können die Octoparse Desktop-App herunterladen, eine vorgefertigte „Twitter“-Vorlage auswählen, die URLs/Schlüsselwörter eingeben und die Aktion in der Cloud ausführen.

Für detailliertere Schritte können Sie den Leitfaden zur Extraktion von Daten aus Twitter (X.com) lesen.

Vorteile der Nutzung von Octoparse für Twitter Scraping

Integrierte Automatisierungs- & Anti-Bot-Funktionen

Es führt automatisch komplexes JavaScript-Rendering durch und unterstützt endloses Scrollen. Es integriert Funktionen wie IP-Rotation und Cloud-Extraktion, um sicherzustellen, dass langfristige Überwachungsaufgaben nicht blockiert werden. Zudem kostet es wesentlich weniger als die offizielle API.

Zuverlässiges langfristiges Twitter-Monitoring

Octoparse und andere No-Code-Twitter-Scraper wie Chat4Data oder Instant Data Scraper helfen dabei, diese Lücke zu schließen. Sie bieten kostengünstiges Scraping in Kombination mit der Zuverlässigkeit eines Managed Service. Wenn sich die Benutzeroberfläche von Twitter ändert, aktualisiert das Octoparse-Team (oder die Vorlagen-Wartung) den Scraper, nicht Sie. Sie können einen Job so einrichten, dass er stündlich ausgeführt wird, und die Ergebnisse werden über einen Webhook oder eine API direkt an Ihre Datenbank gesendet.

Scrapen Sie Daten einfach mit Auto-Detect-Funktionen, es sind keine Programmierkenntnisse erforderlich.

Voreingestellte Scraping-Vorlagen für beliebte Websites, um Daten mit wenigen Klicks zu erhalten.

Werden Sie dank IP-Proxys und erweiterter API nie wieder blockiert.

Cloud-Service, um das Daten-Scraping jederzeit nach Wunsch zu planen.

Direkter Vergleich: Twitter Scraping vs. Twitter-APIs

| Funktion | Offizielle Twitter-API (Pro) | Python/DIY Scraping | No-Code (z. B. Octoparse) |

| Einrichtungszeit | < 1 Tag (API-Schlüssel) | 3-7 Tage (Entwicklung & Tests) | < 2 Stunden (Vorlagen) |

| Monatliche Kosten | ~5.000 $/Monat (Pro-Stufe) | ~200 $/Monat (Proxys + Server) | ~100-300 $/Monat (Standard/Pro-Pläne) |

| 12-Monats-Gesamtkosten | 60.000 $+ (Zusätzlich jemand für die Einrichtung) | 2.400 $ + 50.000 $ (Entwicklergehälter) | 1.200 $ – 3.600 $ |

| Wartung | Keine (Sehr gering) | Hoch (Wöchentliche Fixes) | Gering (Vom Anbieter verwaltet) |

| Datenzuverlässigkeit | 100 % (Goldstandard) | 60-80 % (Anfällig für Ausfälle) | 90-95 % (Hoch) |

| Technische Fähigkeiten | Mittel (JSON/OAuth) | Hoch (Python/Selenium) | Gering (Point & Click) |

| Risiko | Null (Offiziell) | Hoch (Sperren/IP-Blocks) | Gering (Verwaltete Proxys) |

Um Ihnen bei der Entscheidung zu helfen, finden Sie oben eine Aufschlüsselung der drei Ansätze über ein 12-monatiges Monitoring-Projekt hinweg.

Szenario: Überwachung von 2.000 Tweets/Tag (ca. 60.000/Monat) für ein Jahr.

Fazit

Basierend auf einer langfristigen Perspektive ist hier der Entscheidungsrahmen:

- Wenn Sie ein Jahresbudget von 60.000 $ haben, wählen Sie die offizielle Twitter Enterprise/Pro-API. Sie ist die einzige Option, um schnell und ohne Einschränkungen eine garantierte „3-Jahres-Historie“ zu erhalten.

- Wenn Sie Entwickler, aber kein zusätzliches Budget haben, können Sie Python-Scraping ausprobieren. Aber Vorsicht: Es ist ziemlich kompliziert und fehleranfällig, drei Jahre historische Daten durch Scrollen zu sammeln. Höchstwahrscheinlich werden Sie auf „Rate Limit“-Blockaden stoßen, bevor Sie das erste Datenjahr abgeschlossen haben.

- Die ausgewogene Empfehlung: Für die Mehrheit der robusten Anwendungsfälle ist ein No-Code/SaaS-Scraper wie Octoparse ideal.

- Historische Daten: Er kann die „Such“-Funktion automatisieren, um Tweets aus bestimmten Zeiträumen zu finden.

- Kontinuierliches Monitoring: Sie können Aufgaben so einrichten, dass sie jeden Tag ausgeführt werden, um neue Tweets zu erfassen.

Häufig gestellte Fragen (FAQs) zu Twitter Scraping und Twitter-APIs

- Ist das Scraping von Twitter legal oder werde ich verklagt?

Obwohl X (Twitter) Gerichtsverfahren verloren hat, in denen versucht wurde, Firmen daran zu hindern, öffentliche Daten zu sammeln, behält das Unternehmen die Befugnis, Ihr Konto zu sperren und Ihre IP-Adresse zu blockieren, wenn Sie gegen die Nutzungsbedingungen verstoßen.

Das Scrapen öffentlicher Tweets ohne Anmeldung (was derzeit schwer umzusetzen ist) oder das Betrachten öffentlicher Profile mit Wegwerf-Konten ist eine Sache. Das Scrapen privater Daten, Direktnachrichten oder die Nutzung Ihres Hauptgeschäftskontos kann jedoch die offizielle Präsenz Ihrer Marke dem Risiko einer Sperrung aussetzen.

- Kann ich wirklich 3 Jahre historische Daten erhalten, ohne 42.000 $ für die Enterprise-API zu zahlen?

Ja, aber es erfordert Geduld und die richtigen Werkzeuge.

- Offizielle API: Die „Pro“-Stufe (5.000 $/Monat) bietet Zugriff auf die vollständige Archivsuche, sodass Sie sofort Tweets ab 2021 abrufen können. Die „Basis“-Stufe (100 $/Monat) durchsucht nur die letzten 7 Tage.

- Scraping: Ein Scraper kann 3 Jahre zurückgehen, indem er die Parameter der „erweiterten Suche“ verwendet (z. B. from:user since:2024-01-01 until:2026-12-31). Sie können jedoch nicht einfach drei Jahre lang „nach unten scrollen“; der Browser würde abstürzen. Um die Paginierung erfolgreich zu bewältigen, müssen Sie den Prozess in kleinere Teile aufteilen (z. B. Monat für Monat scrapen) und ein Tool wie Octoparse verwenden.

- Warum kann ich nicht einfach die „Basis“-API-Stufe für 100 $ für das Monitoring nutzen?

Die Basis-Stufe erlaubt es Ihnen nur, 10.000 Tweets pro Monat zu lesen. Wenn Sie einer beliebten Marke oder einem Trendthema folgen, können Sie dieses Limit an einem einzigen Nachmittag überschreiten. Sobald Sie das Limit erreicht haben, wird Ihr Datenstrom bis zum nächsten Zahlungsmonat abgeschaltet. Für ein kontinuierliches, langfristiges Monitoring, bei dem Datenlücken inakzeptabel sind, reicht die Basis-Stufe selten aus.

- Wird mein persönlicher Twitter-Account gesperrt, wenn ich ihn für das Scraping verwende?

Ja, das ist sehr wahrscheinlich. Wenn Sie Ihre persönlichen Anmeldedaten (Cookies) in einem Python-Skript oder Scraping-Tool verwenden, werden die Anti-Bot-Algorithmen von Twitter „nicht-menschliche“ Aktivitäten erkennen. Solche Aktivitäten beinhalten in der Regel das schnelle Aufrufen von Links, das Klicken von Buttons oder das Ausfüllen von Formularen.

Verwenden Sie niemals Ihr Hauptkonto. Ernsthafte Monitoring-Projekte nutzen einen Pool von „Wegwerf“-Konten oder, noch besser, eine No-Code-Plattform wie Octoparse, die Sitzungen und Proxys in Ihrem Namen verwaltet und so Ihre Identität von den Scraping-Aktivitäten trennt.

- Warum sollte ich für ein Tool wie Octoparse bezahlen, wenn ich einfach einen Python-Entwickler einstellen könnte?

Es läuft auf die Wartungskosten hinaus. Ein Python-Skript, das Sie heute schreiben, wird wahrscheinlich nächste Woche nicht mehr funktionieren, wenn Twitter seinen Website-Code aktualisiert (z. B. durch Änderung eines Klassennamens).

- Python: Sie können jederzeit einen Entwickler einstellen, der das Skript ständig wartet und patcht, aber Sie müssen auch separat für Server und Proxys bezahlen, was mit zunehmender Skalierung teurer wird.

- No-Code (Octoparse): Die Wartung wird ausgelagert und vollständig von der Plattform übernommen. Wenn sich das Layout von Twitter ändert, wird das Octoparse-Team die Vorlage umgehend aktualisieren. Sie zahlen eine feste monatliche Gebühr für ein funktionierendes Tool anstelle einer ungewissen Gebühr für die Aktualisierung von fehlerhaftem Code und Infrastruktur.

Im Vergleich dazu sind No-Code-Tools wie Octoparse viel erschwinglicher, insbesondere für kleinere Unternehmen.

- Was sind die schnellsten Web-Scraper-Optionen für Twitter?

APIs sind am schnellsten, aber die meisten Nutzer wählen No-Code- oder Cloud-Tools für eine praktische, stabile Leistung. Einige Web-Scraper wie Octoparse (hier Octoparse MCP ansehen) bieten MCP, das sich mit LLMs für KI-gestütztes Scraping verbinden kann, was schneller, bequemer und einfacher für Nicht-Programmierer ist.

- Insgesamt am schnellsten: Offizielle X-API → höchste Geschwindigkeit, höchste Kosten

- Bestes Gleichgewicht (Geschwindigkeit + Kosten): Cloud-Scraper (z. B. Apify)

- Am schnellsten einzurichten: No-Code-Tools wie Octoparse, Chat4Data

- Theoretisch schnell, aber instabil: DIY-Skripte (Playwright, Puppeteer)